Nemotron 3

NVIDIA Nemotron 3の革新性

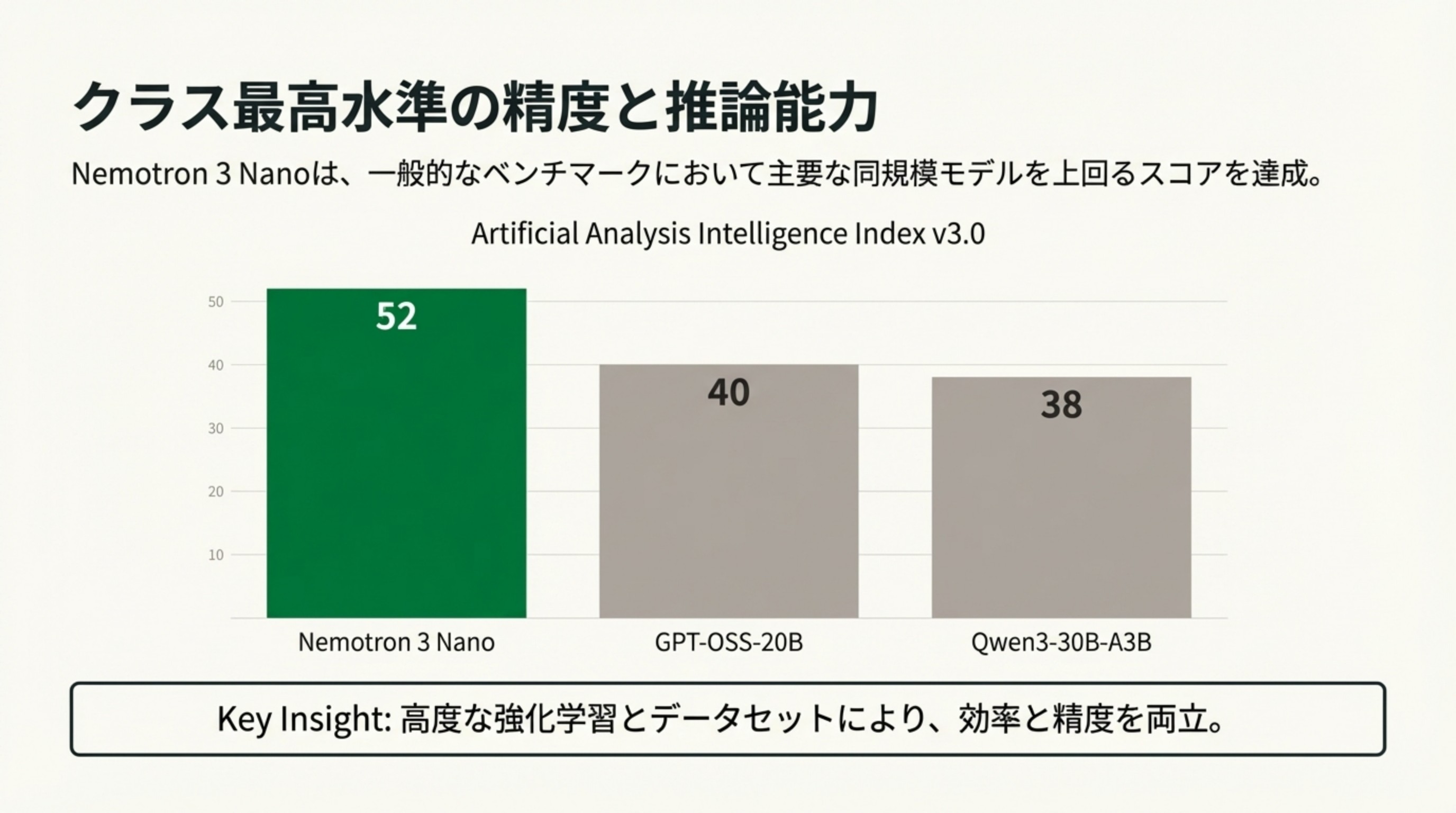

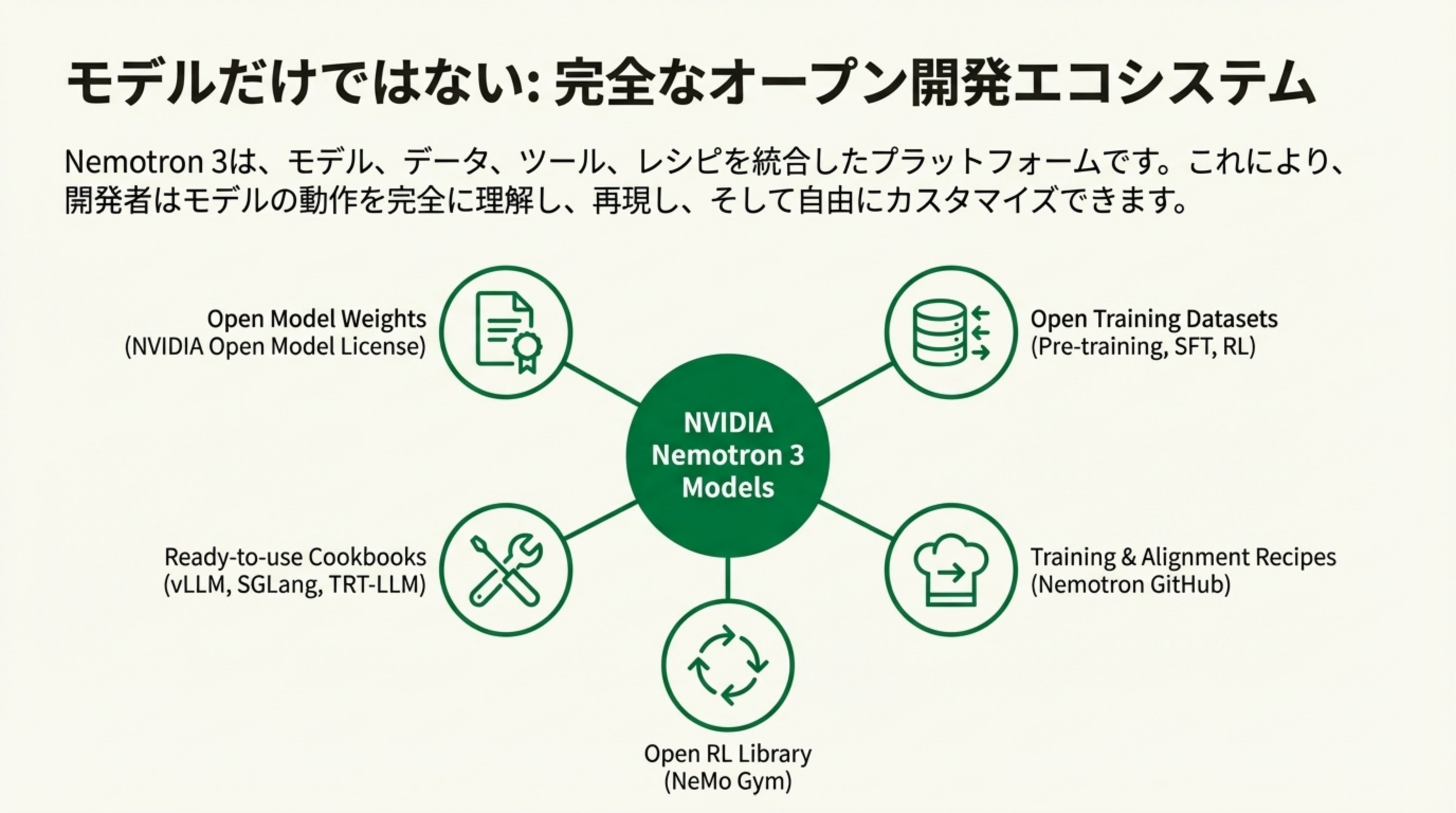

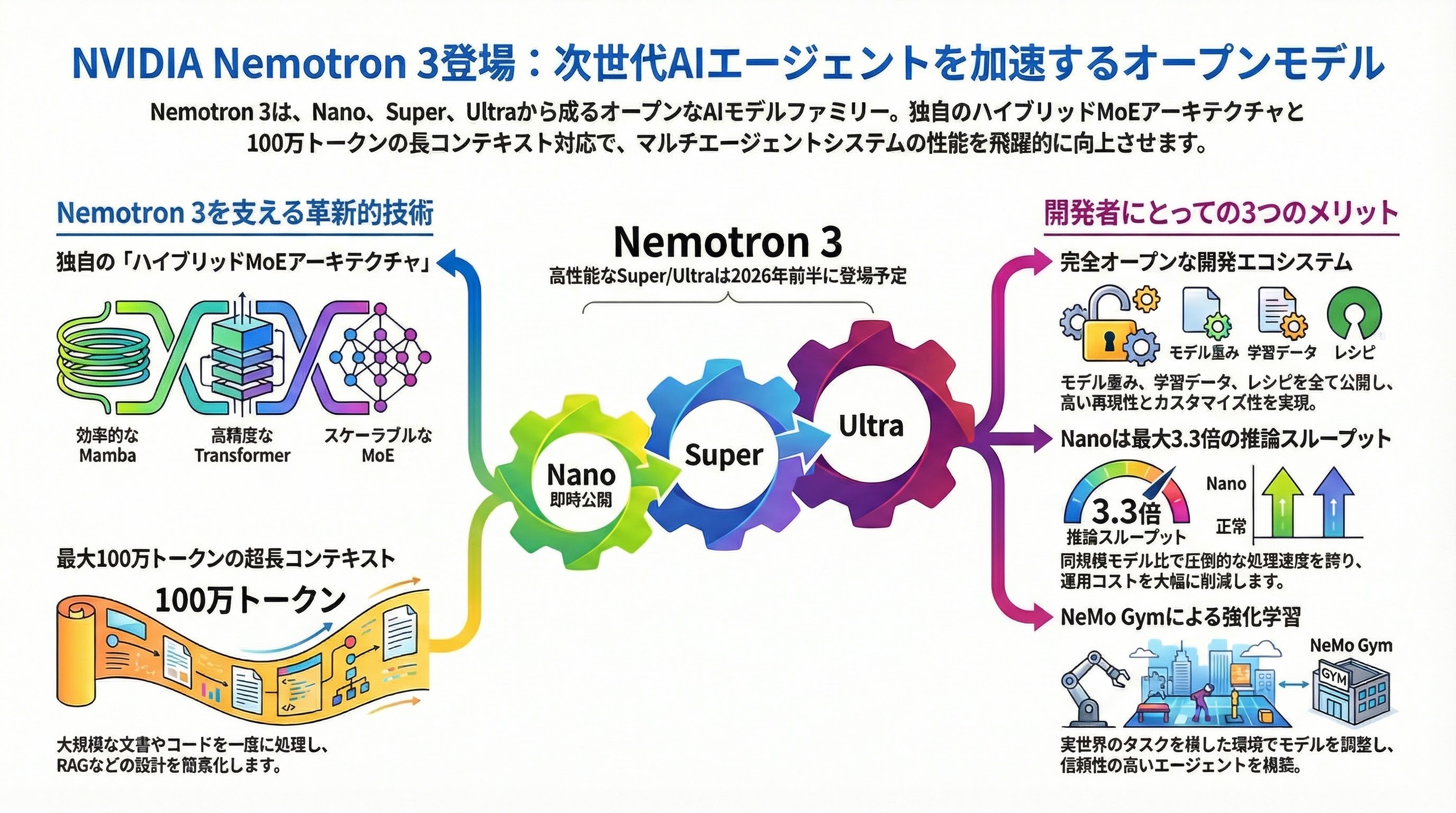

NVIDIAによるNemotron 3ファミリーの発表は、AIエージェント開発における「技術的なターニングポイント」です。性能、効率、そして開発者のための開放性を融合させ、エージェントAIのコストパフォーマンス曲線を再定義します。

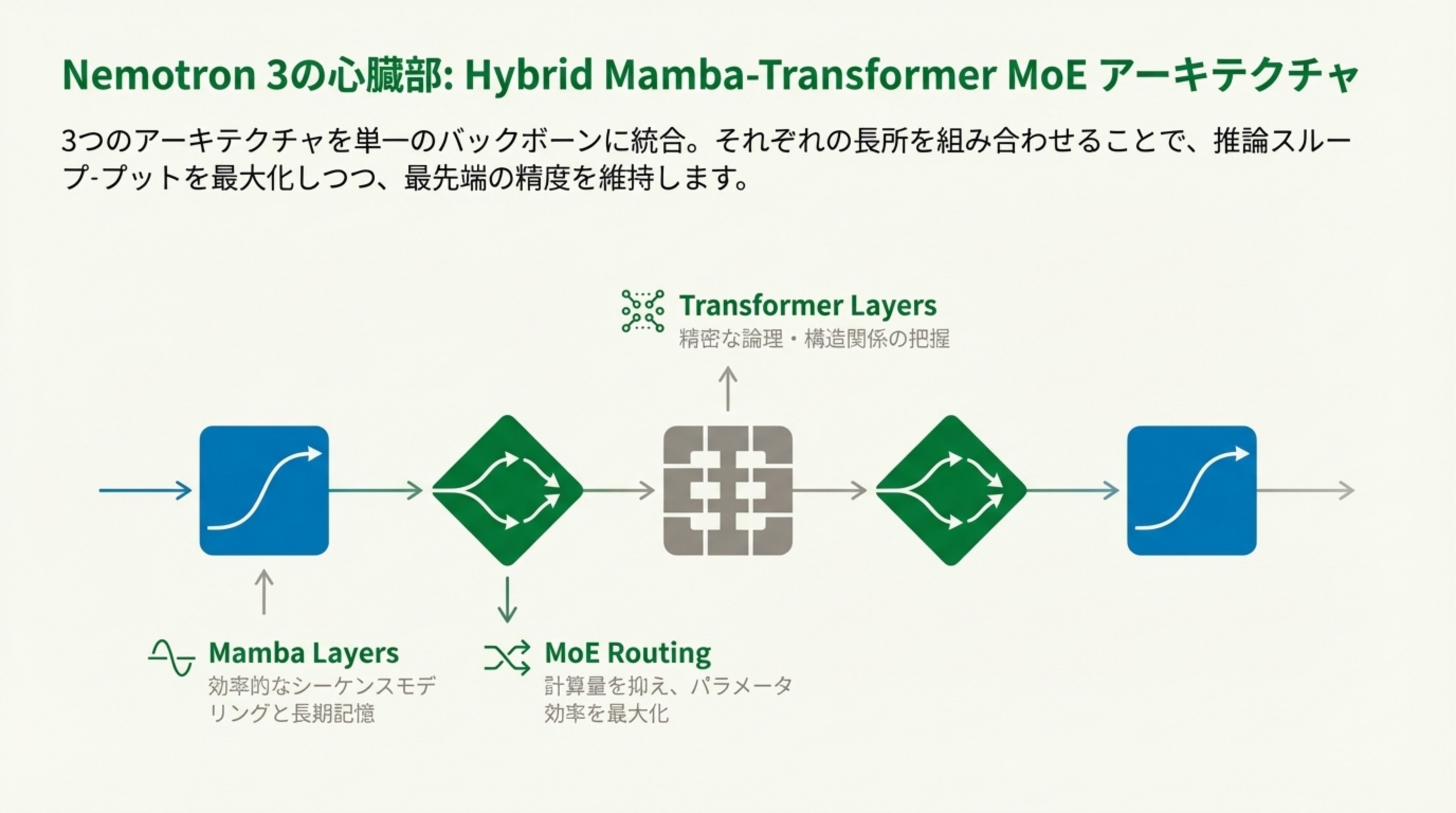

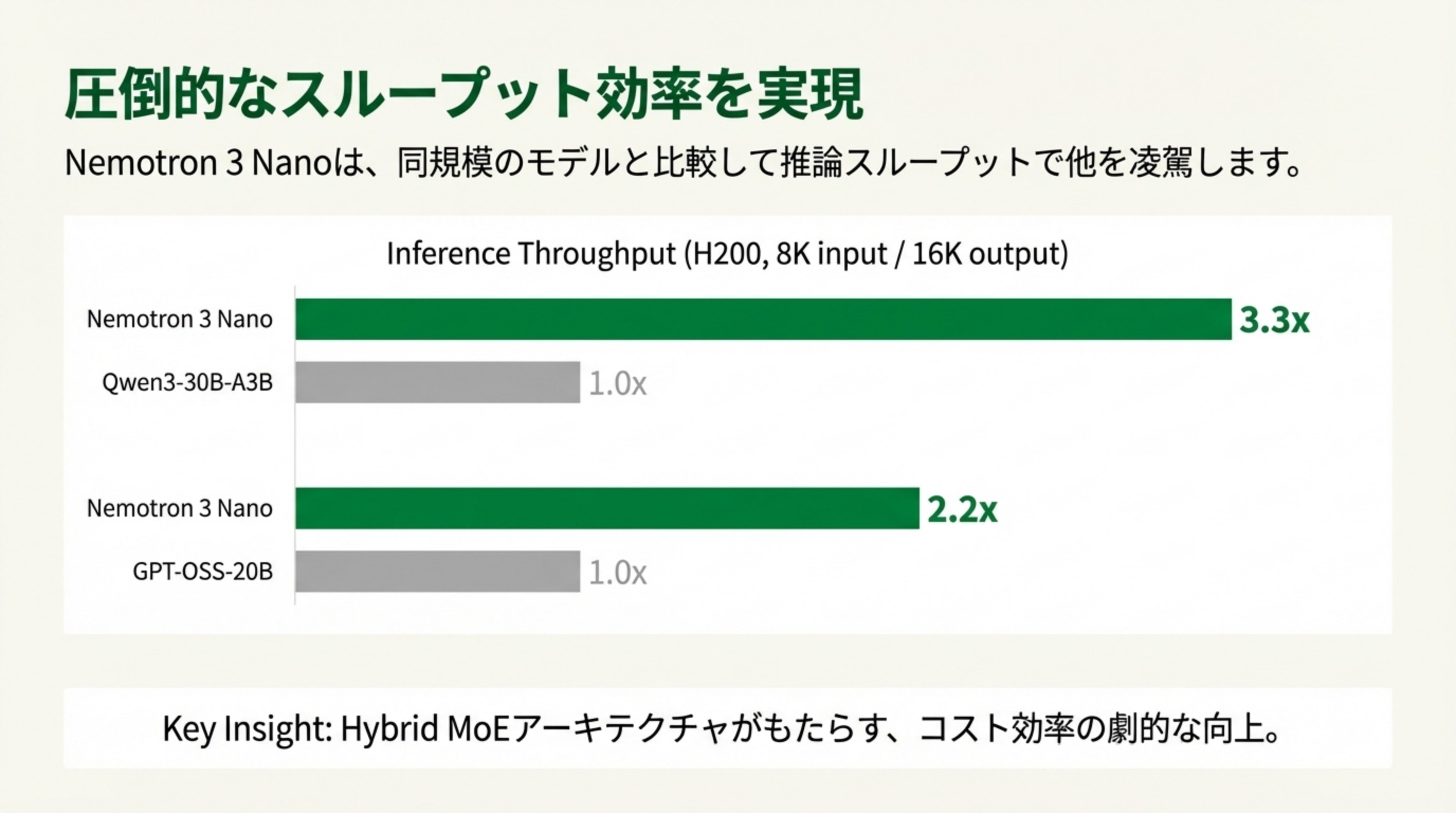

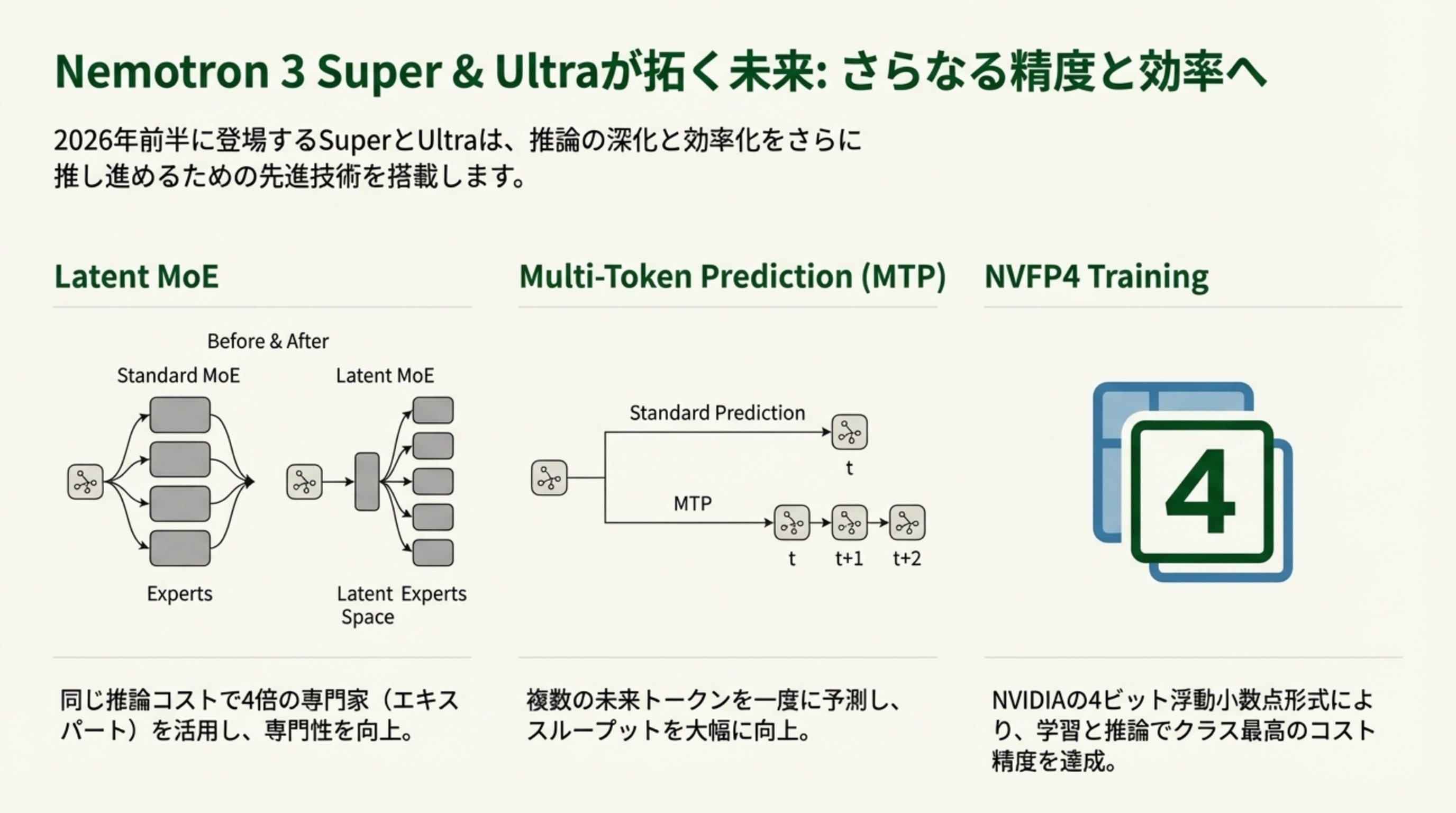

ハイブリッドMamba-Transformer MoEアーキテクチャ

💡 ハイブリッドMamba-Transformer MoEアーキテクチャ

- 1 Mamba: 効率的なシーケンスモデリングで1Mトークンの超長文脈を処理。

- 2 Transformer: 高精度な推論、構造的・論理的関係の把握。

- 3 Mixture-of-Experts (MoE): 計算効率のスケーラビリティと低レイテンシ化。

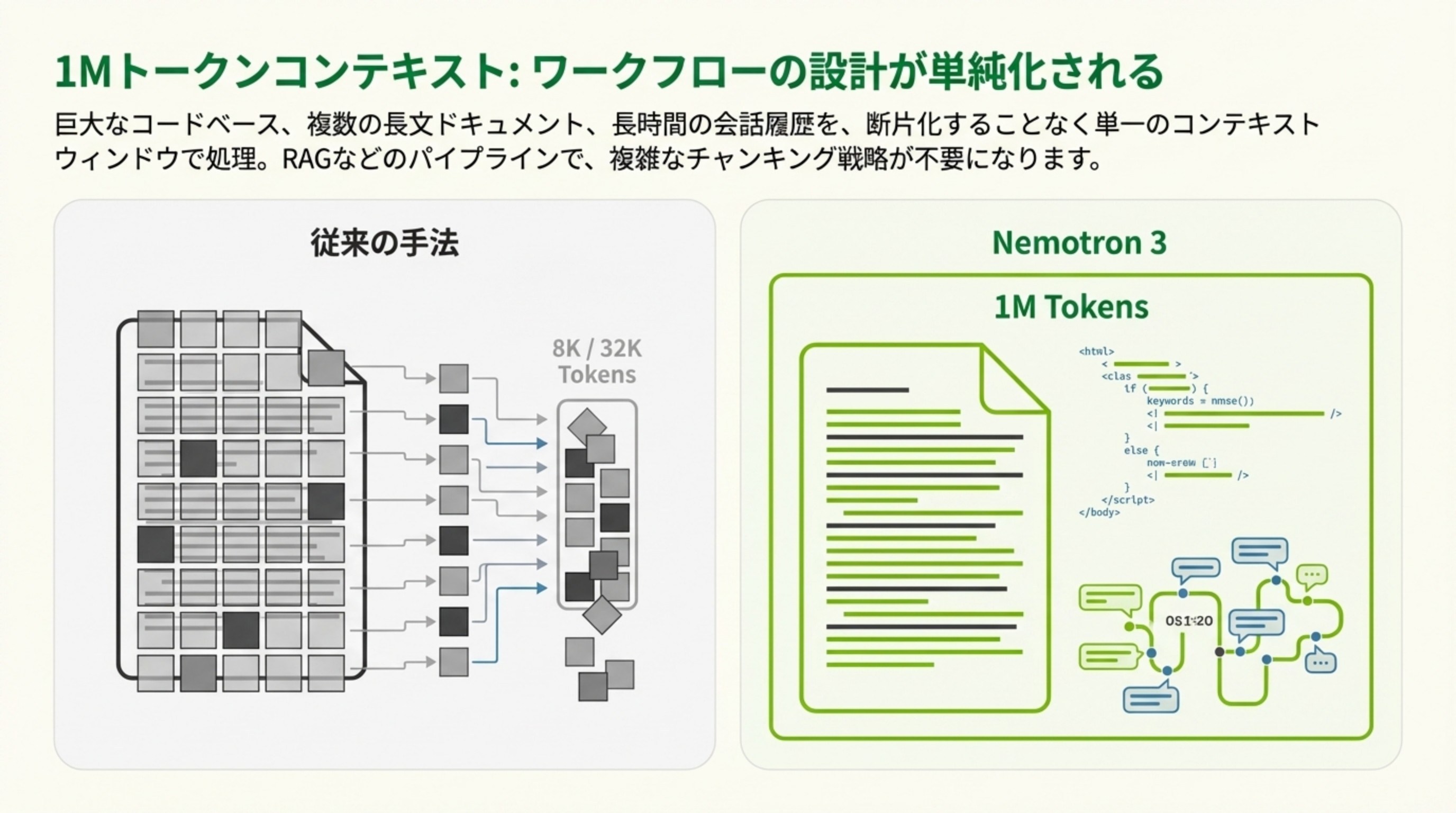

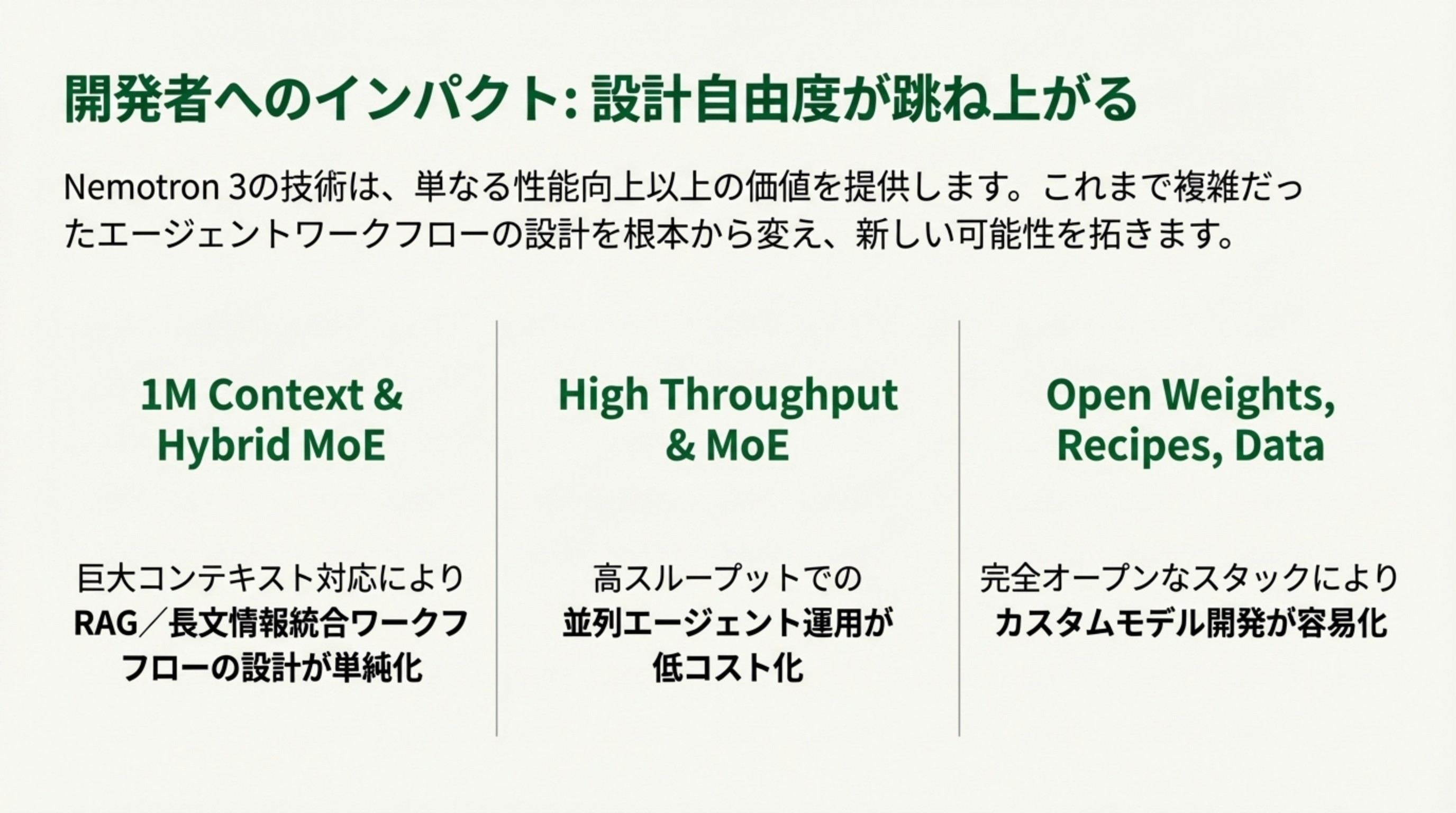

1Mトークン コンテキスト

- RAG設計の単純化

- 巨大なコードベースやドキュメントを直接参照可能

- 事実のグラウンディング改善

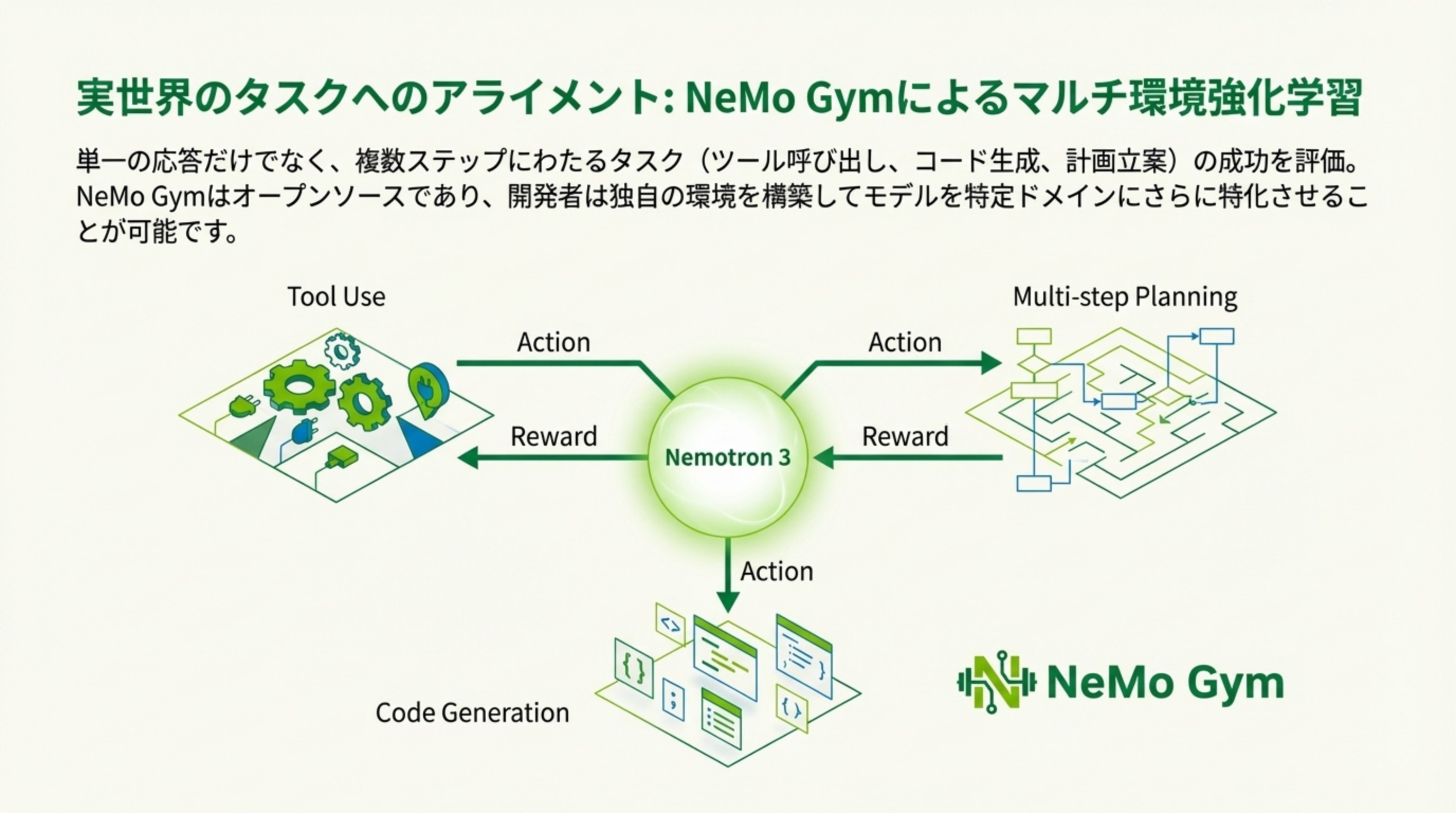

マルチ環境強化学習 (RL)

- NeMo Gymを用いた軌道ベースRL

- 複数ステップのタスク遂行能力向上

- 推論のドリフト抑制