NVIDIA Rubin

年次リリースサイクルを維持する次世代AIプラットフォーム

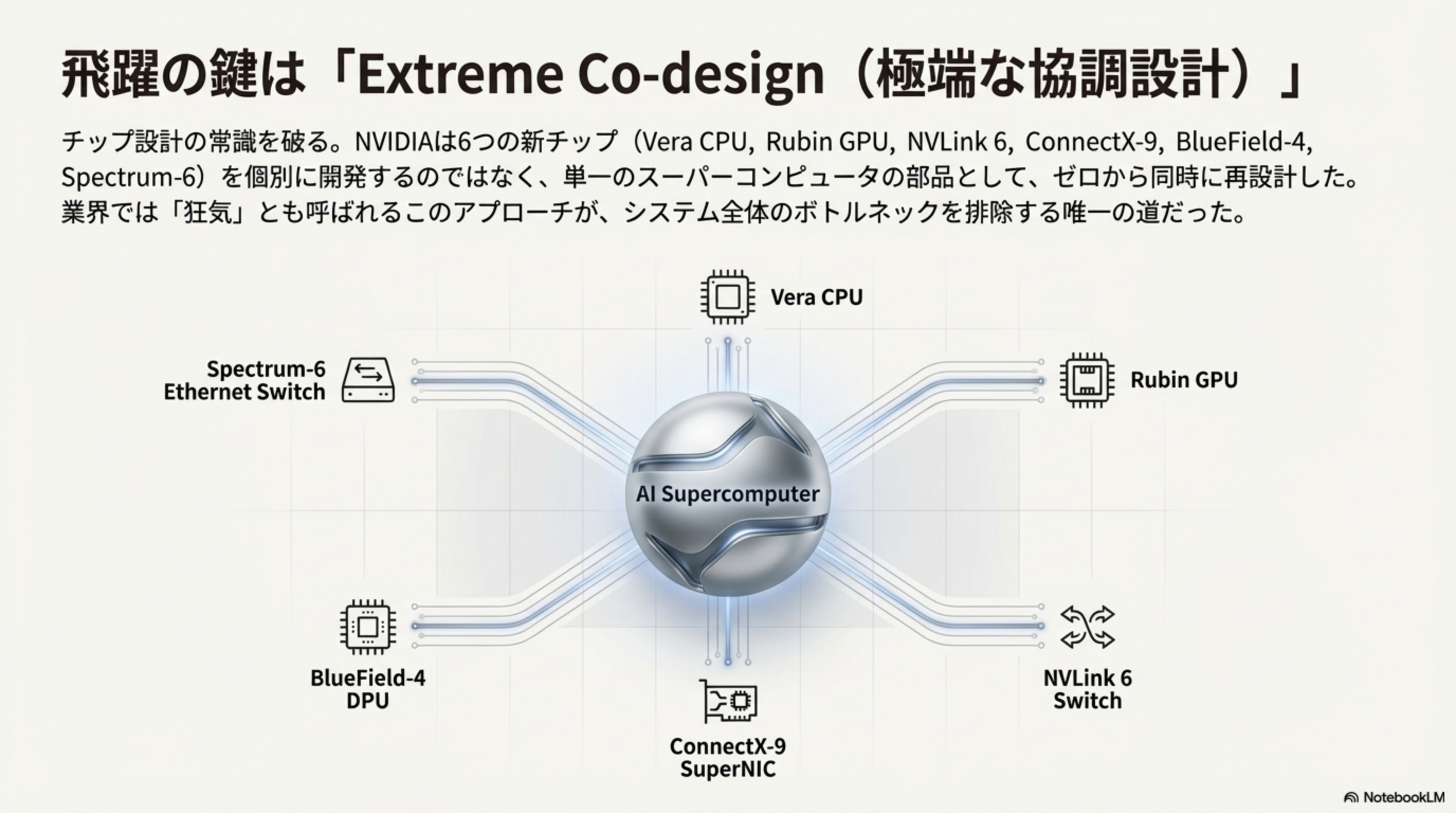

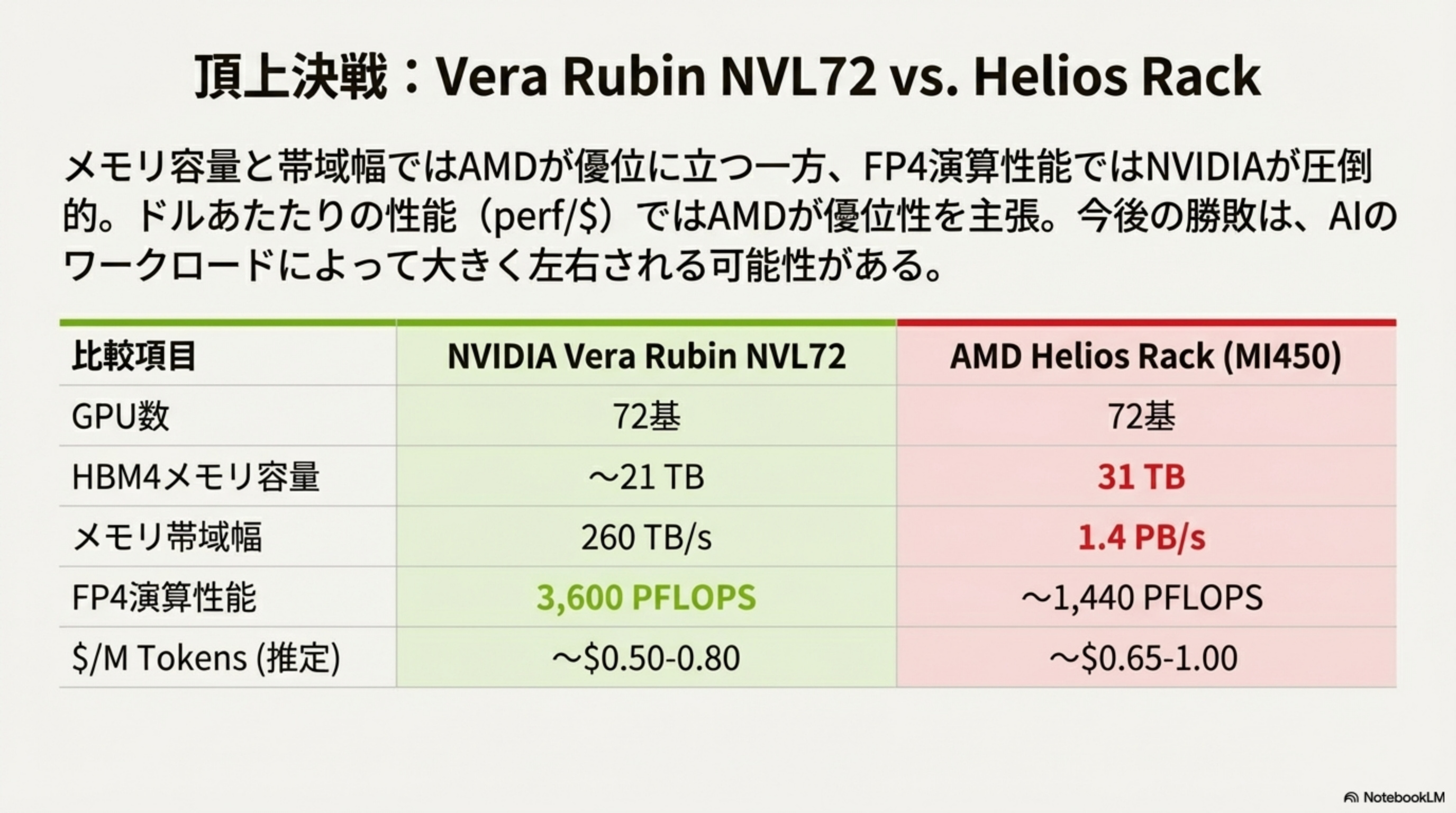

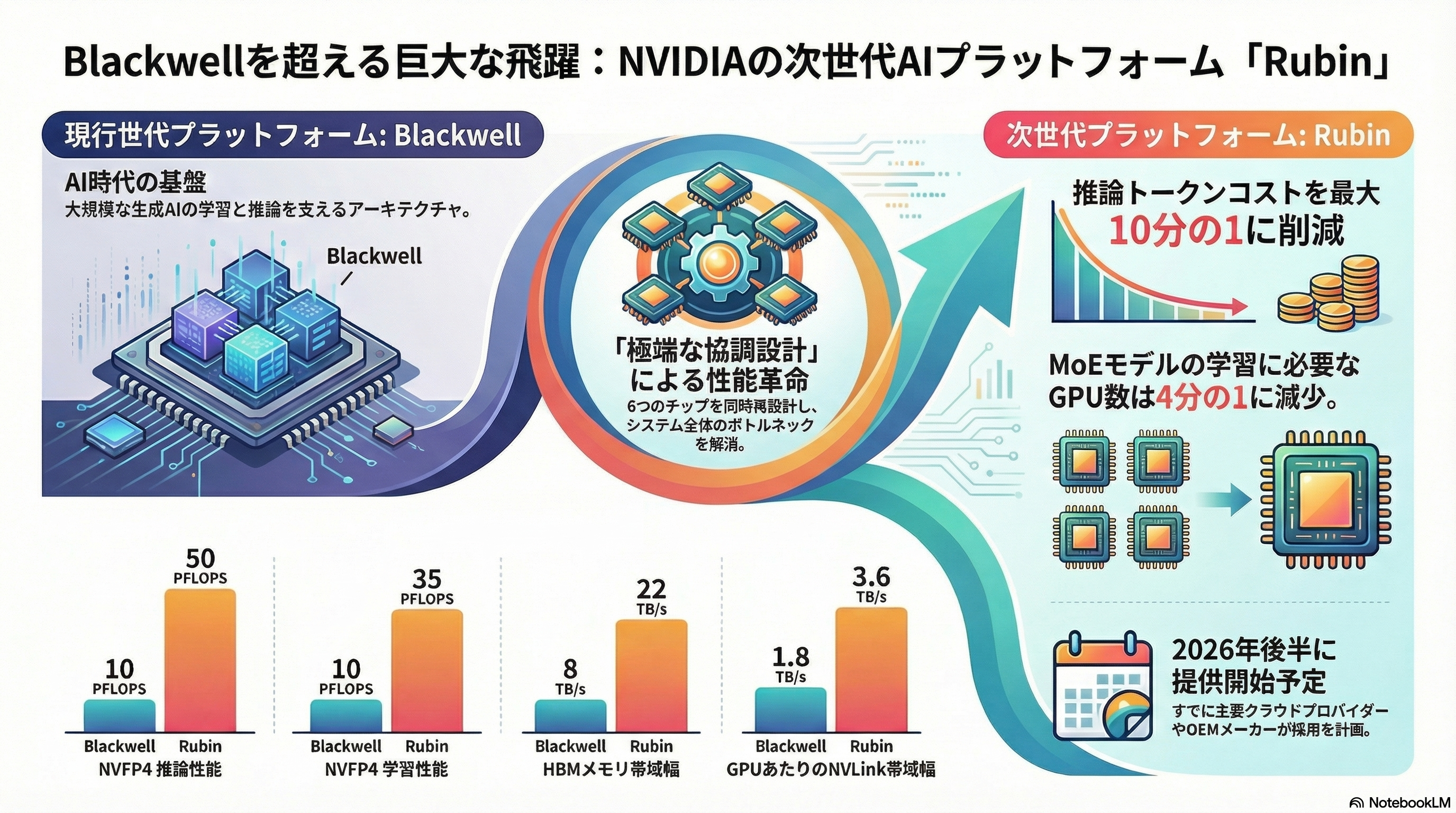

NVIDIAはCES 2026において、Blackwellアーキテクチャの後継となる次世代AIプラットフォーム「Rubin」を発表しました。6種類の新チップを統合し、エージェント型AI、長文脈推論、MoEモデルといった次世代AIワークロードに最適化された単一のAIスーパーコンピュータとして機能します。

性能向上の詳細

⚡ 性能向上の概要

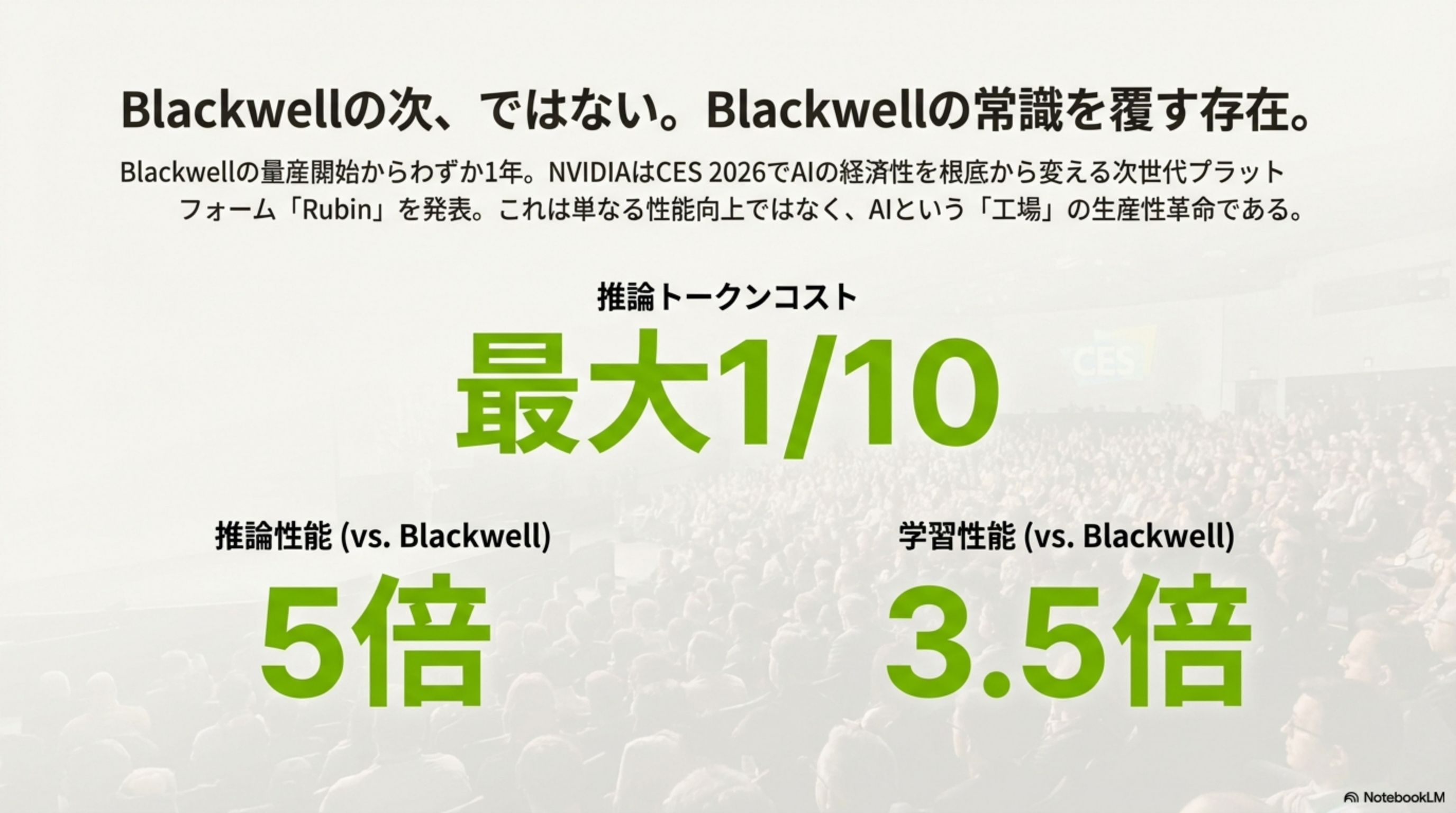

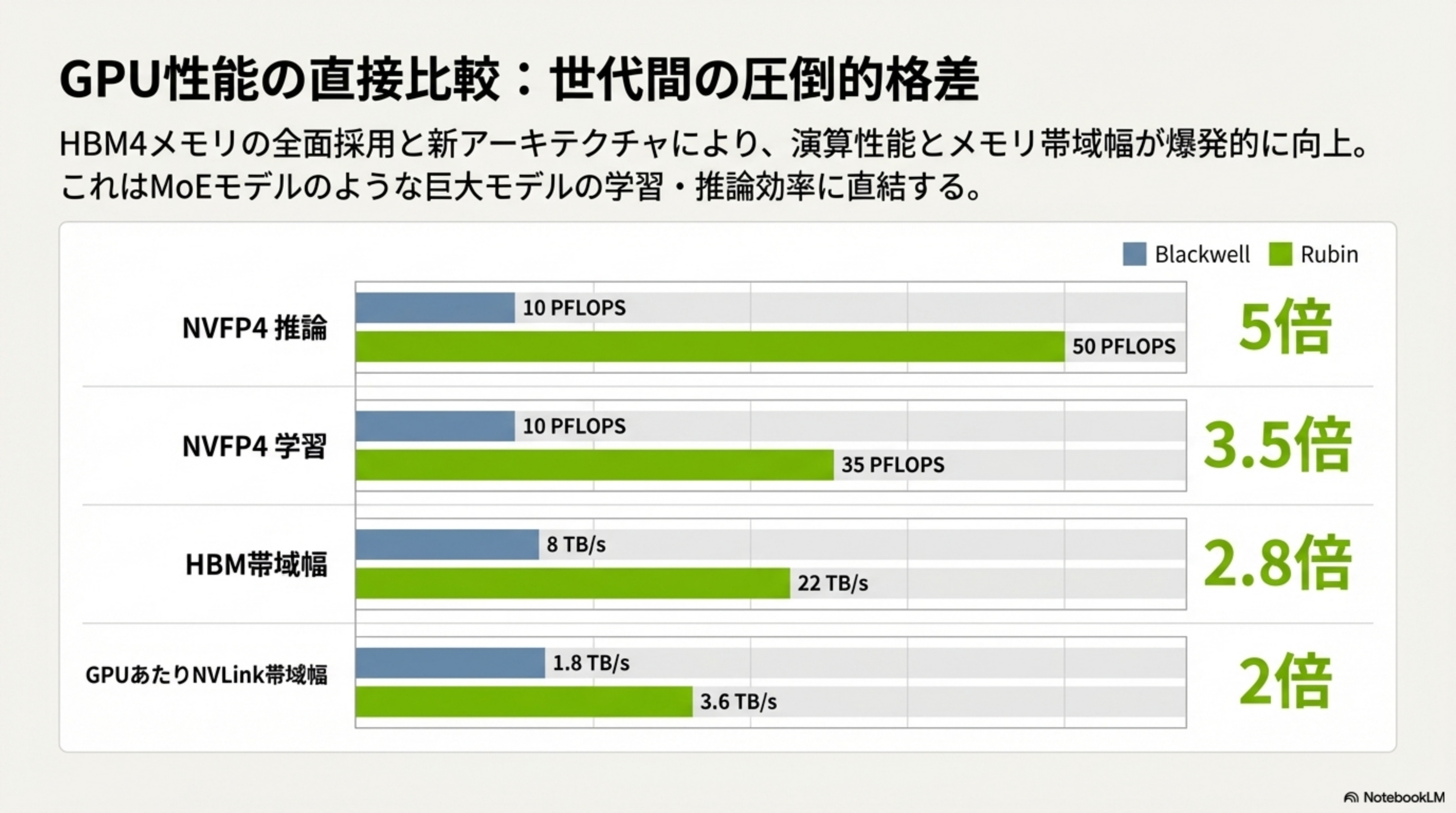

- 1 推論性能: 最大5倍 - Blackwell比で次世代AIモデルの推論処理速度を大幅向上

- 2 トレーニング性能: 最大3.5倍 - 大規模モデルの学習効率を劇的に改善

- 3 コスト削減: 1/10 - 推論トークンコストを最大10分の1に削減

- 4 MoE GPU削減: 1/4 - 混合専門家モデルのトレーニングに必要なGPU数を4分の1に削減

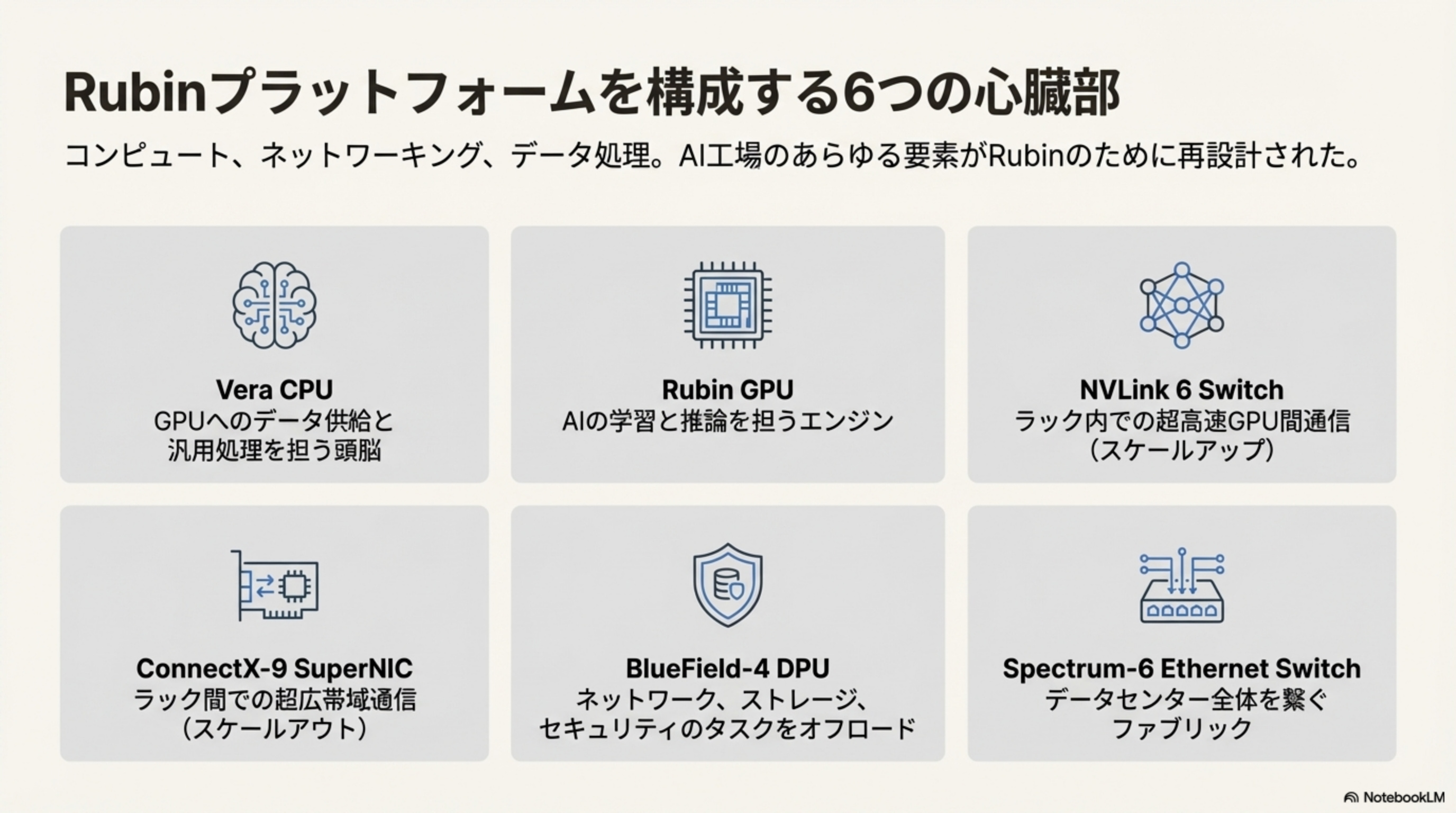

6チップ統合

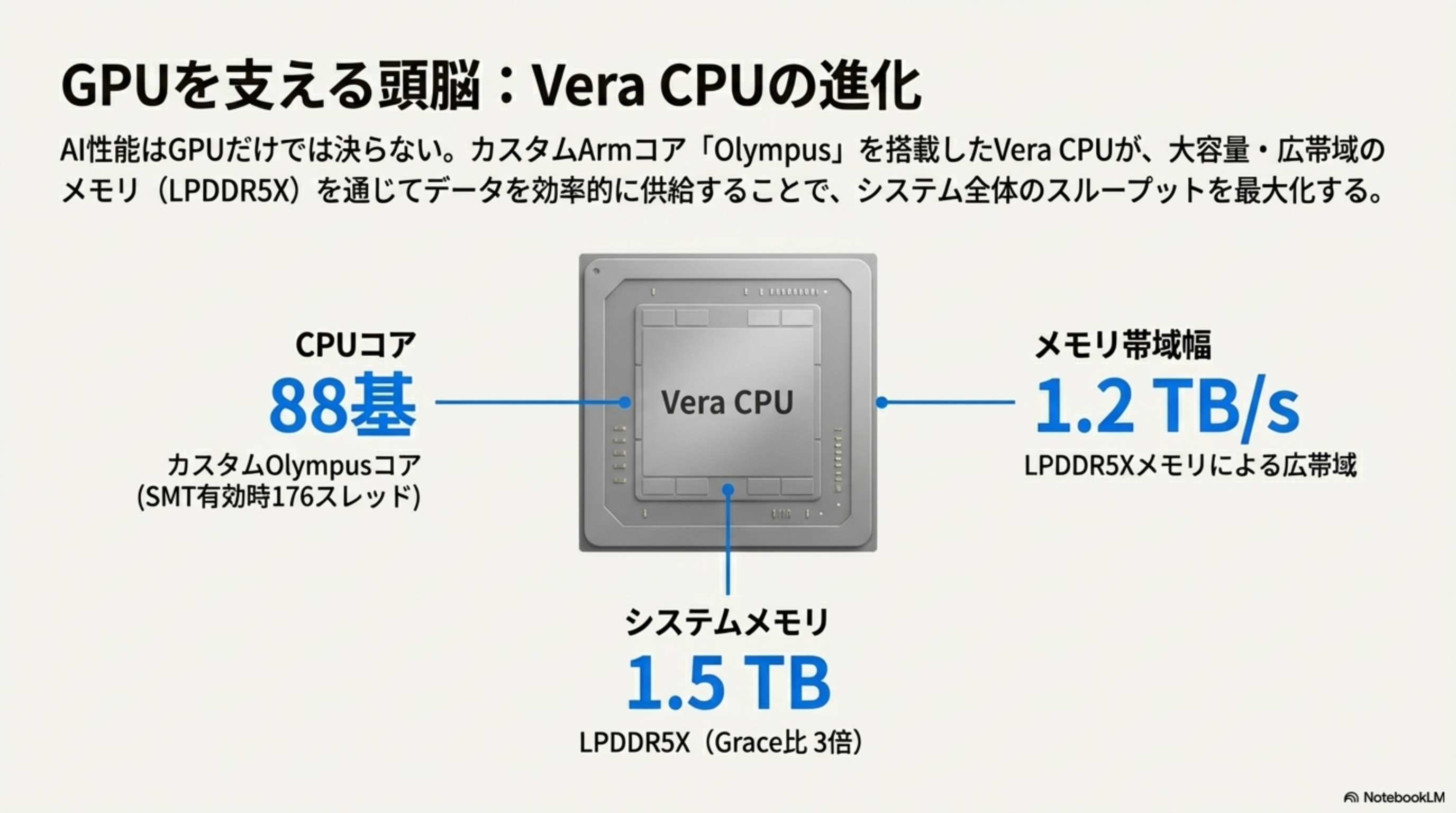

Vera CPU、Rubin GPUを含む6種類の新チップを単一システムとして統合

ラック規模の最適化

計算、ネットワーキング、ストレージを単一ユニットとして最適化

次世代AIワークロード

エージェント型AI、長文脈推論、MoEモデルに特化した設計

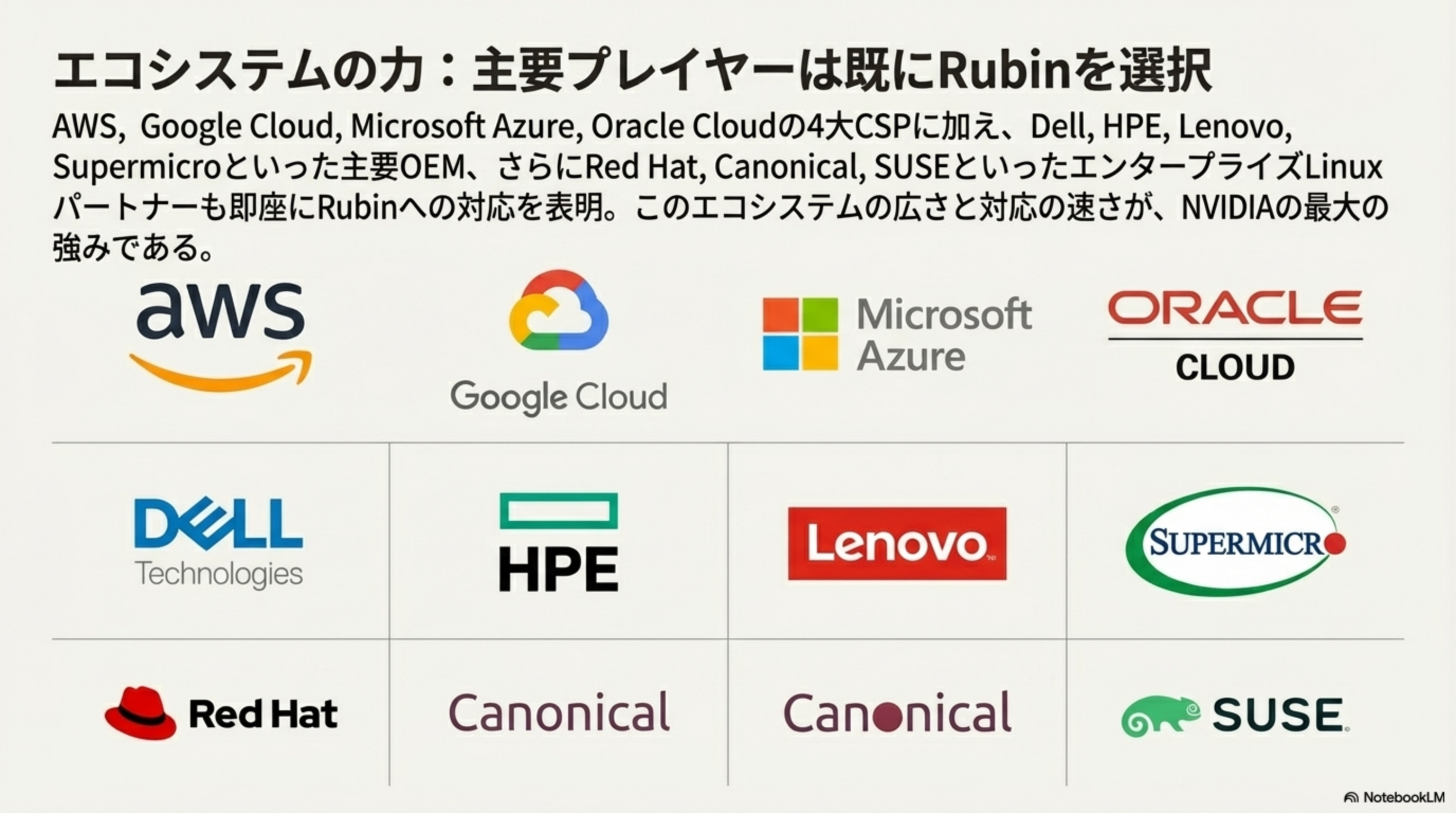

市場展開とパートナーシップ

発表時点で既に完全生産体制(in full production)にあることが明言されており、Microsoft、CoreWeaveを含む主要なクラウドプロバイダーやAIラボが初期導入パートナーとして名を連ねています。Canonical、Red Hat、SUSEなどのエンタープライズLinuxパートナーも最適化されたサポートを表明しており、AIインフラ市場におけるNVIDIAの支配的地位をさらに強固にするものと見られています。パートナー企業によるRubinベースのシステムは、2026年後半に出荷が開始される予定です。

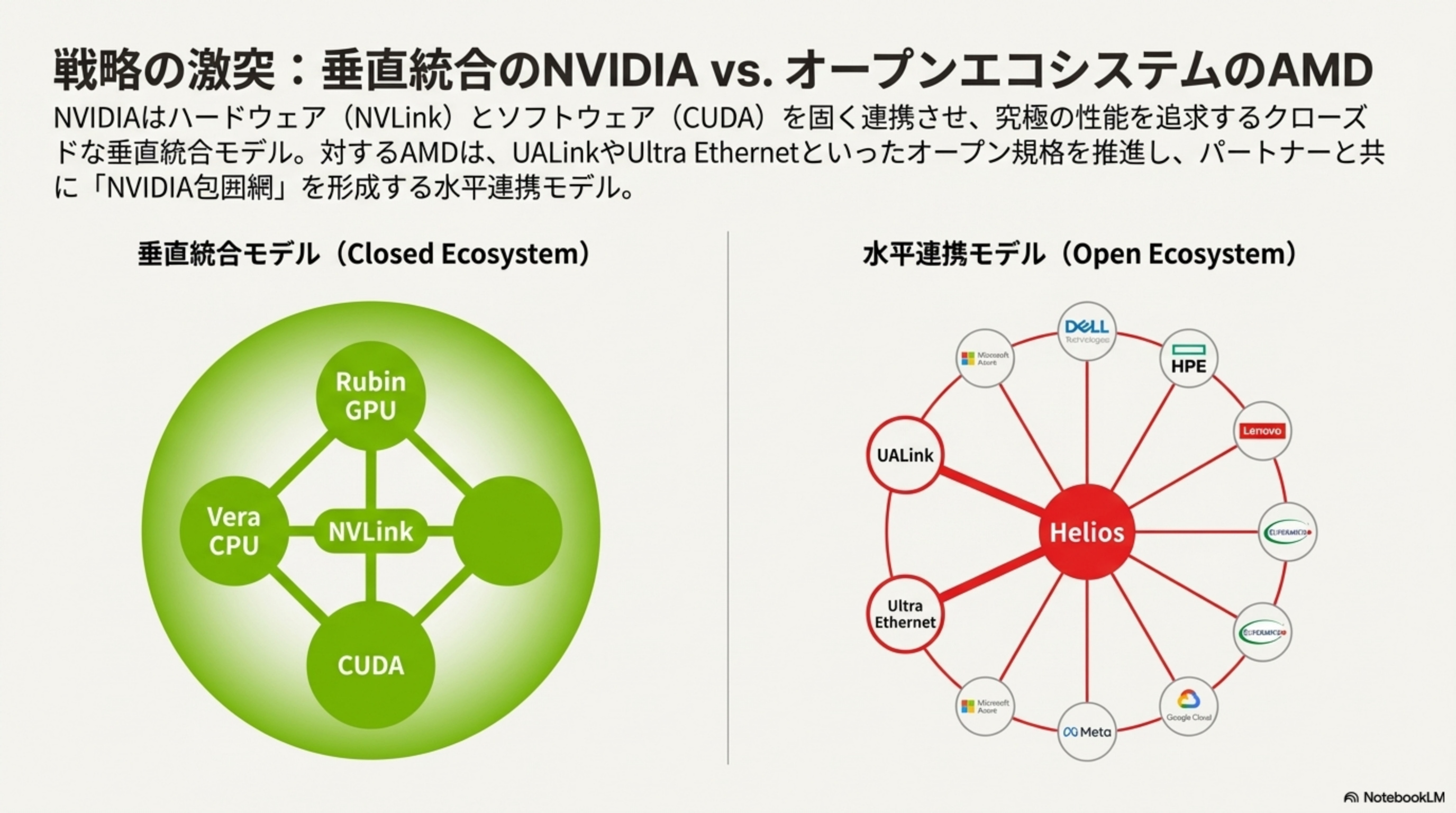

戦略的焦点: システム全体のバランス

Rubinの戦略的焦点は、単なる計算能力の向上だけでなく、システム全体のバランスと効率を重視することにあります。これは、長文脈を理解し、複数の行動を調整するような、より高度な「思考する」AIの需要に応えるためです。プラットフォームは、計算、ネットワーキング、ストレージを単一のユニットとして扱うラック規模の統合を実現し、最先端AIの構築と展開にかかるコストを大幅に削減することを目標としています。