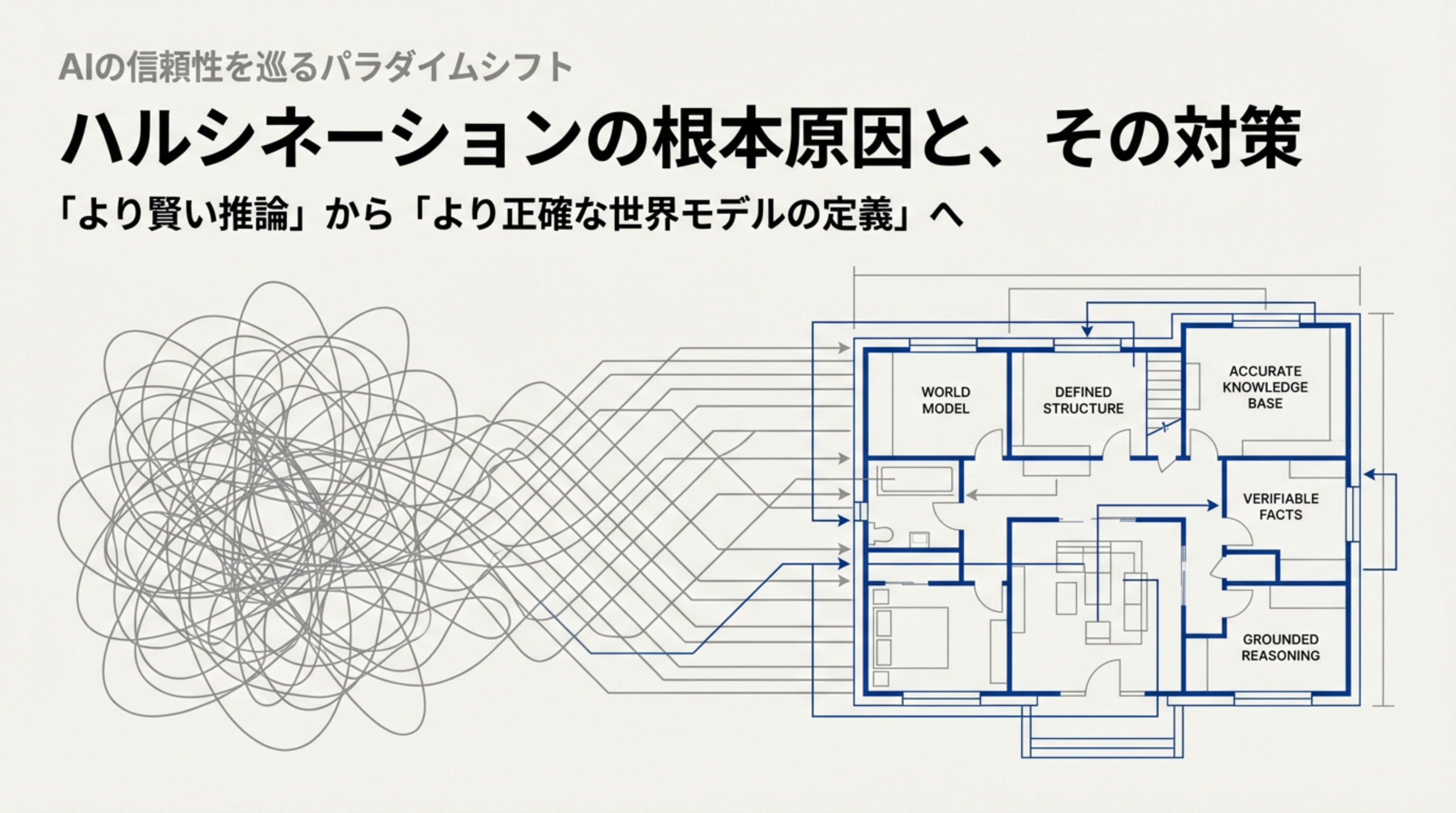

Defining The AI World

ハルシネーションを防ぐ構造的アプローチ

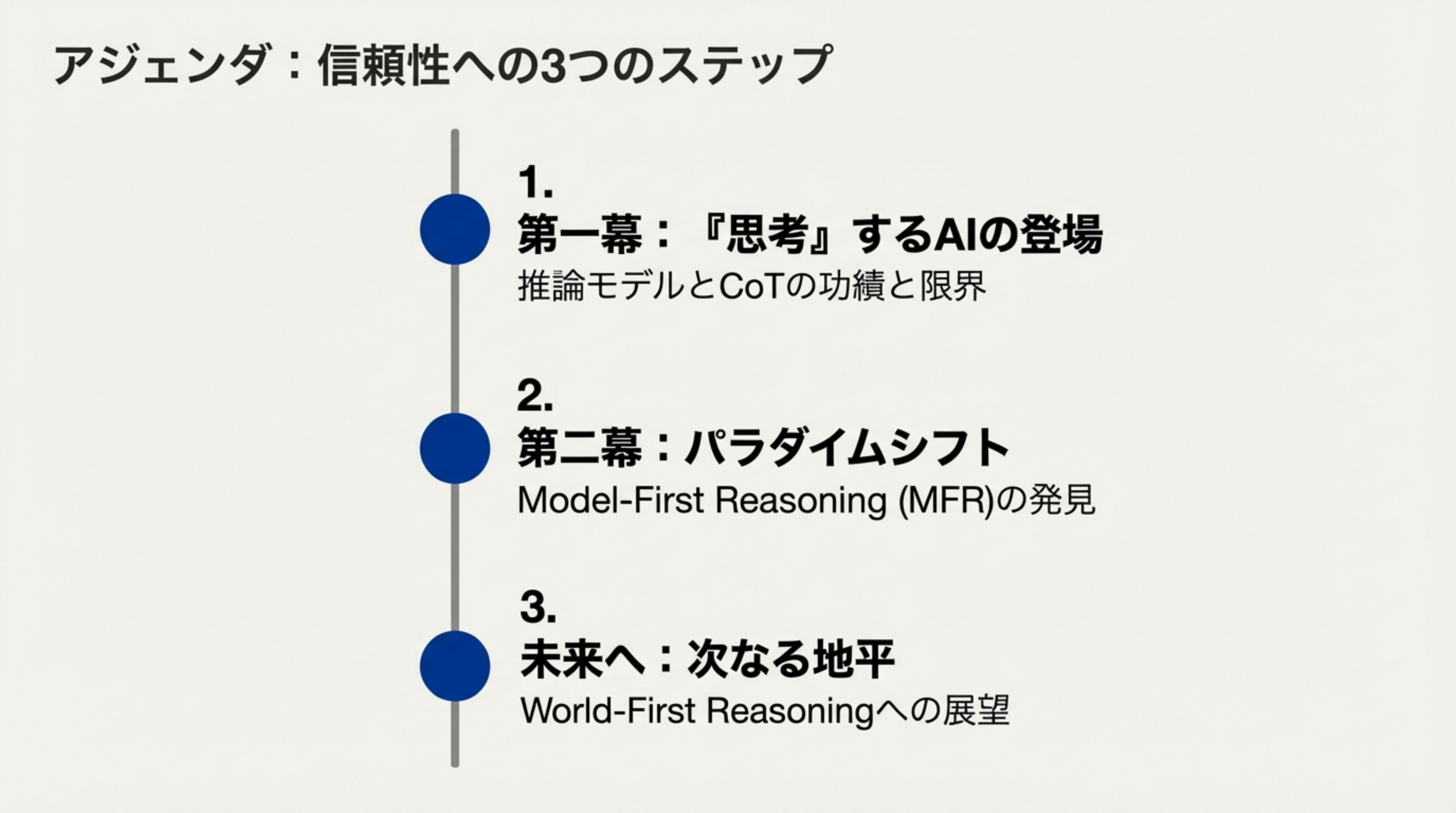

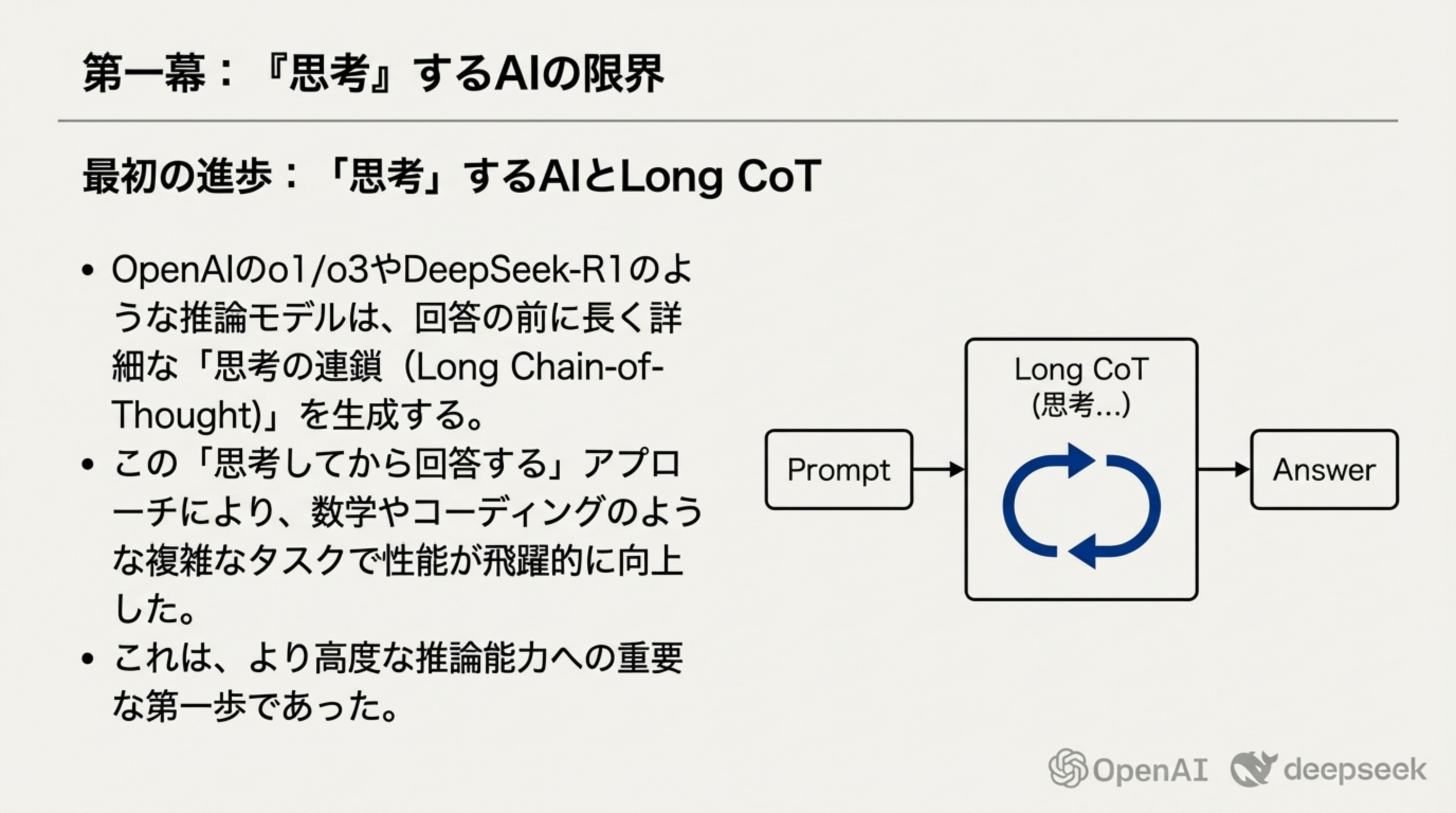

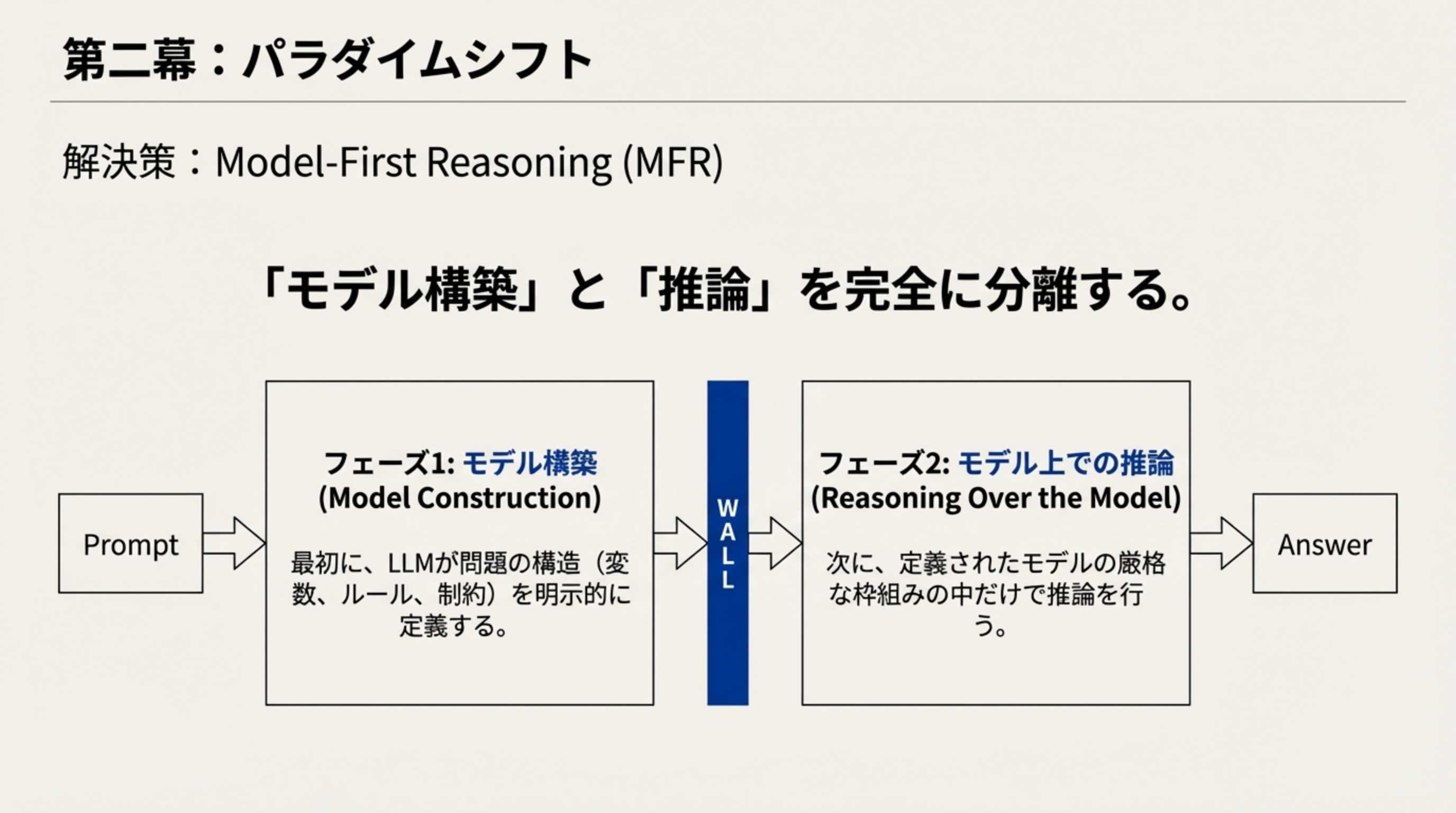

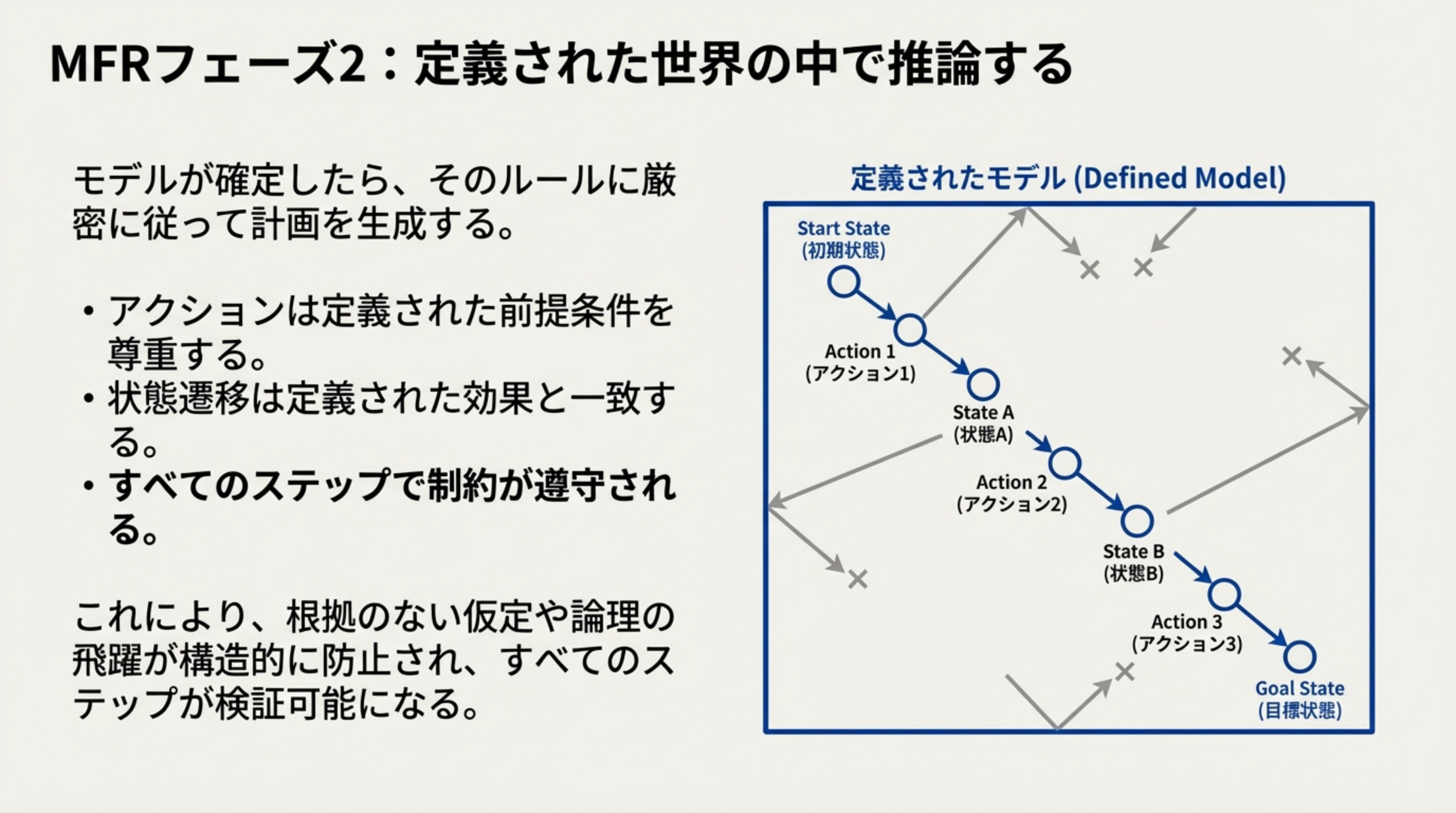

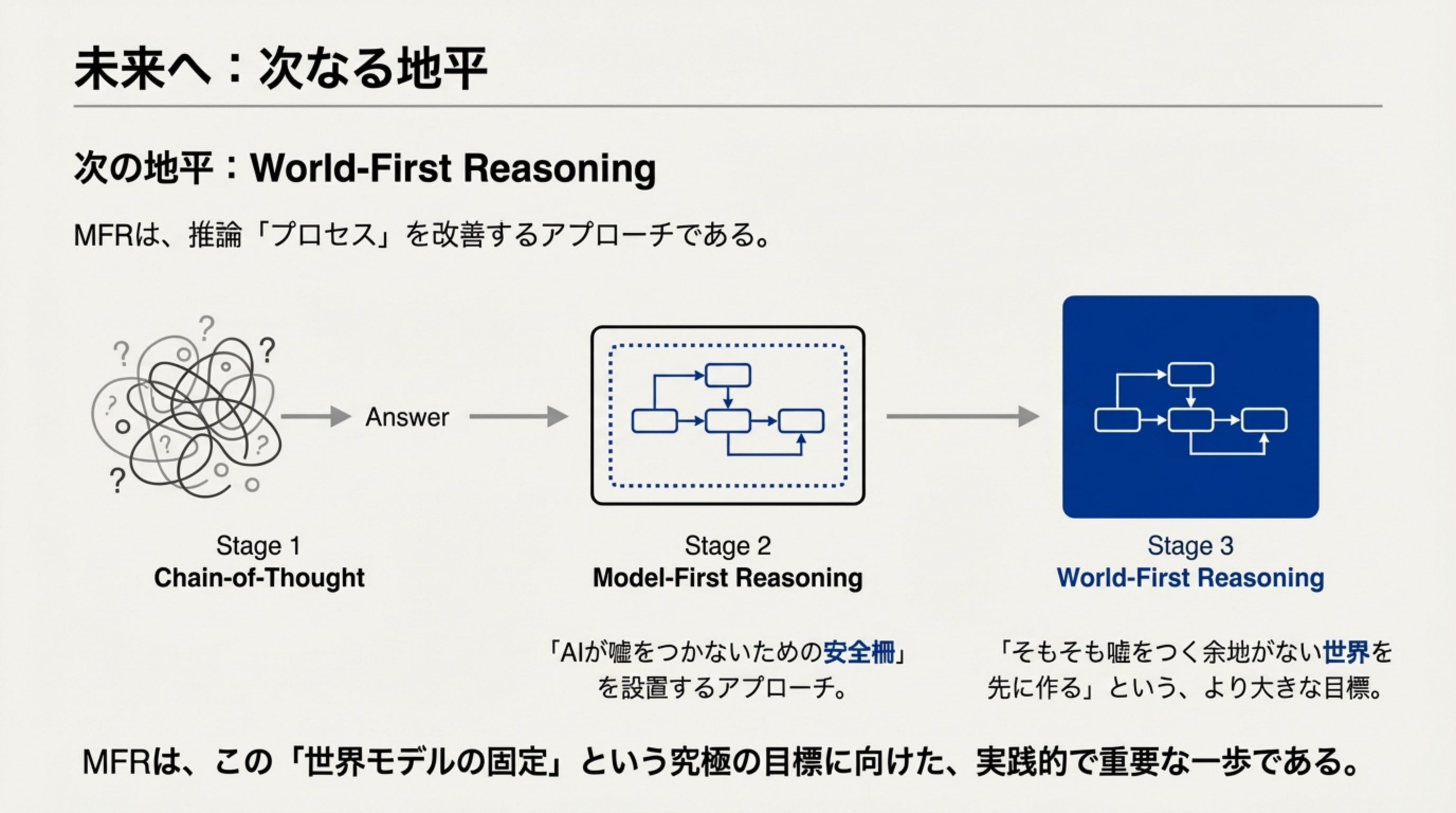

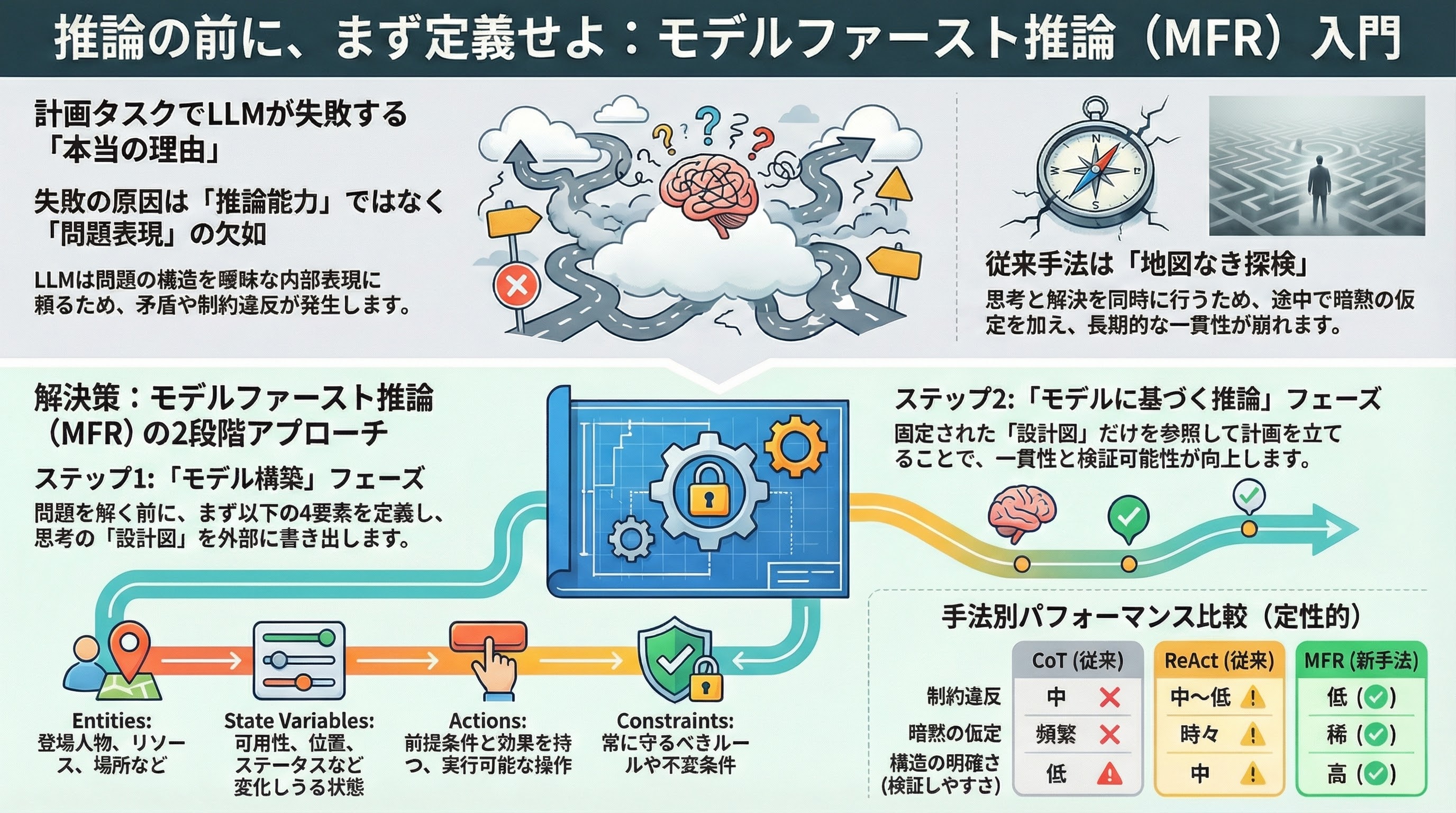

LLMにまず明示的な問題モデルを構築させる「Model-First Reasoning」により、計画の信頼性が飛躍的に向上します。タスクのルールを事前に定義することで、一貫性のある検証可能な計画が可能になります。

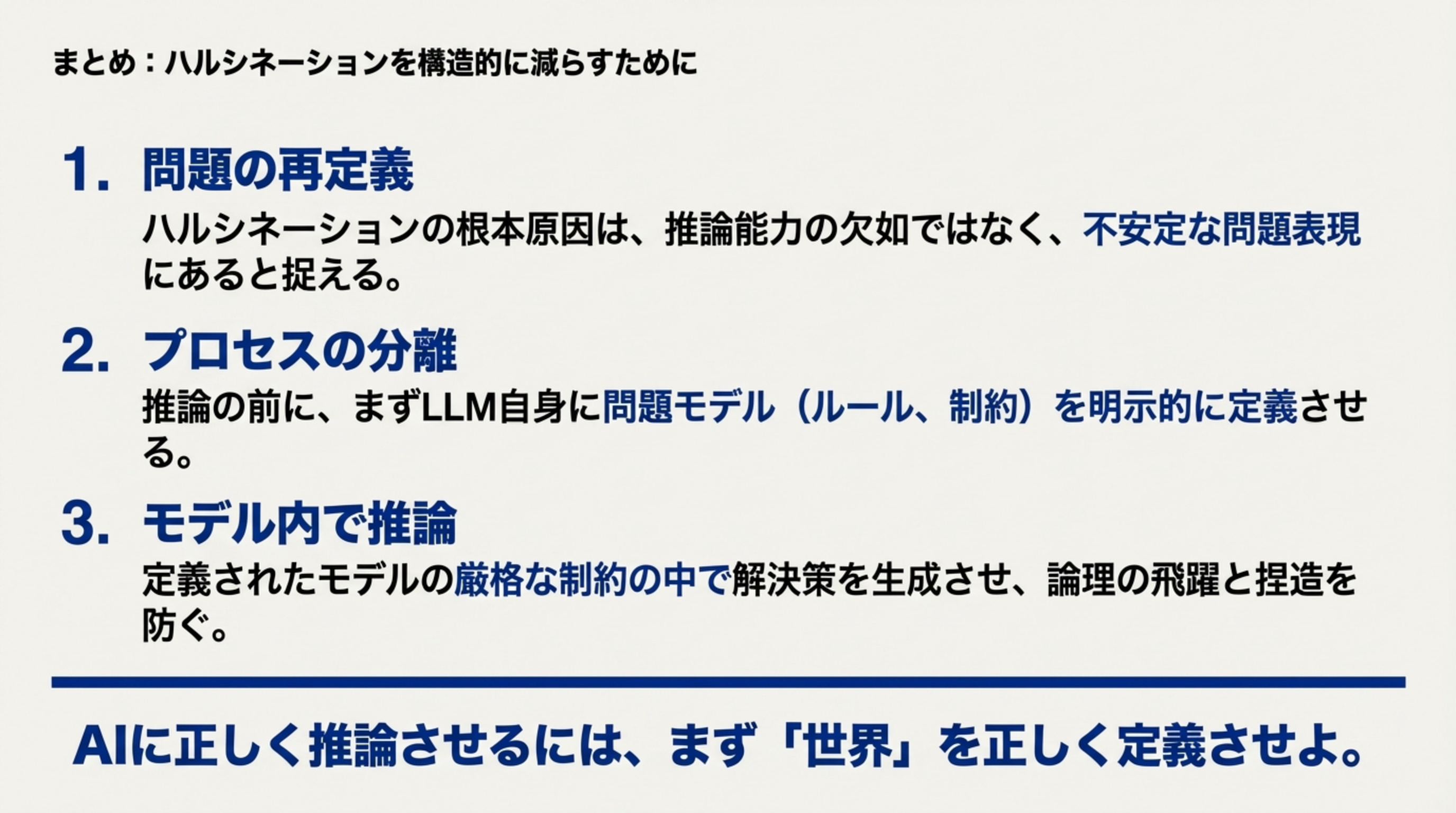

構造的ハルシネーション防止

📐 Model-First Reasoningの利点

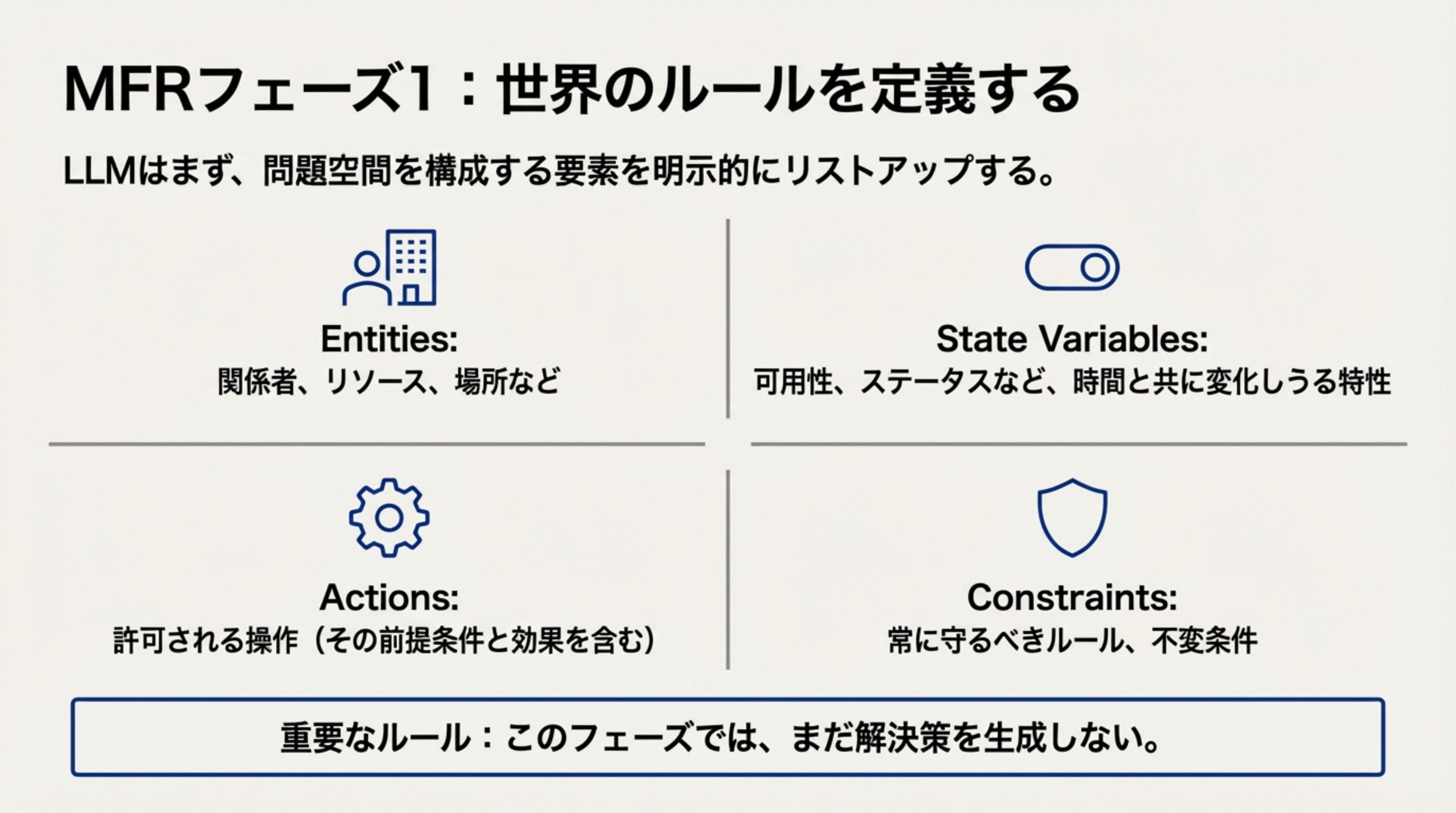

- 1 明示的な問題定義: 計画前に「何が存在し、何が許可されるか」をリストアップ。

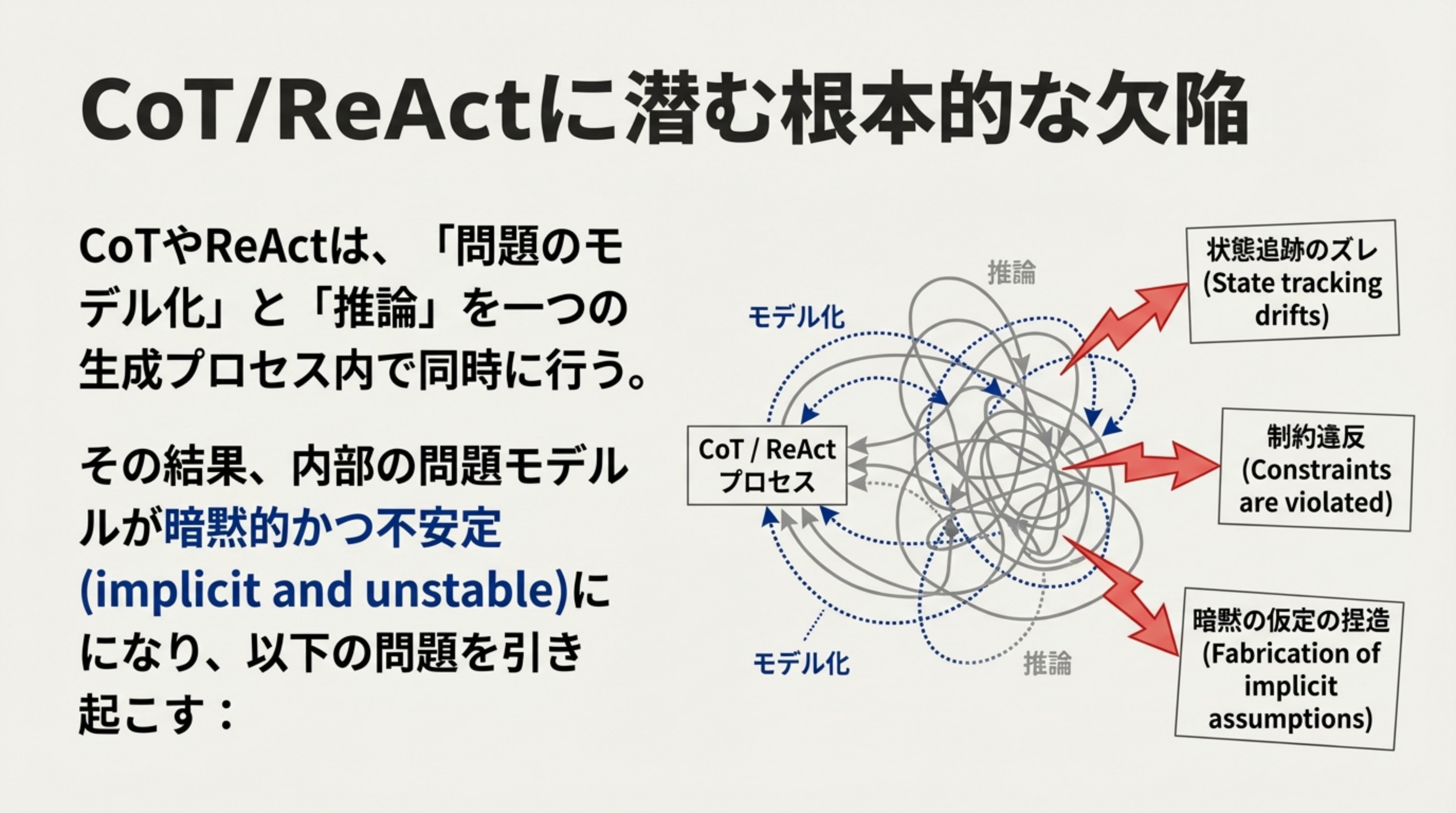

- 2 表現と推論の分離: 長期的なドリフトを減らし、隠れた仮定の発明(ハルシネーション)を防ぐ。

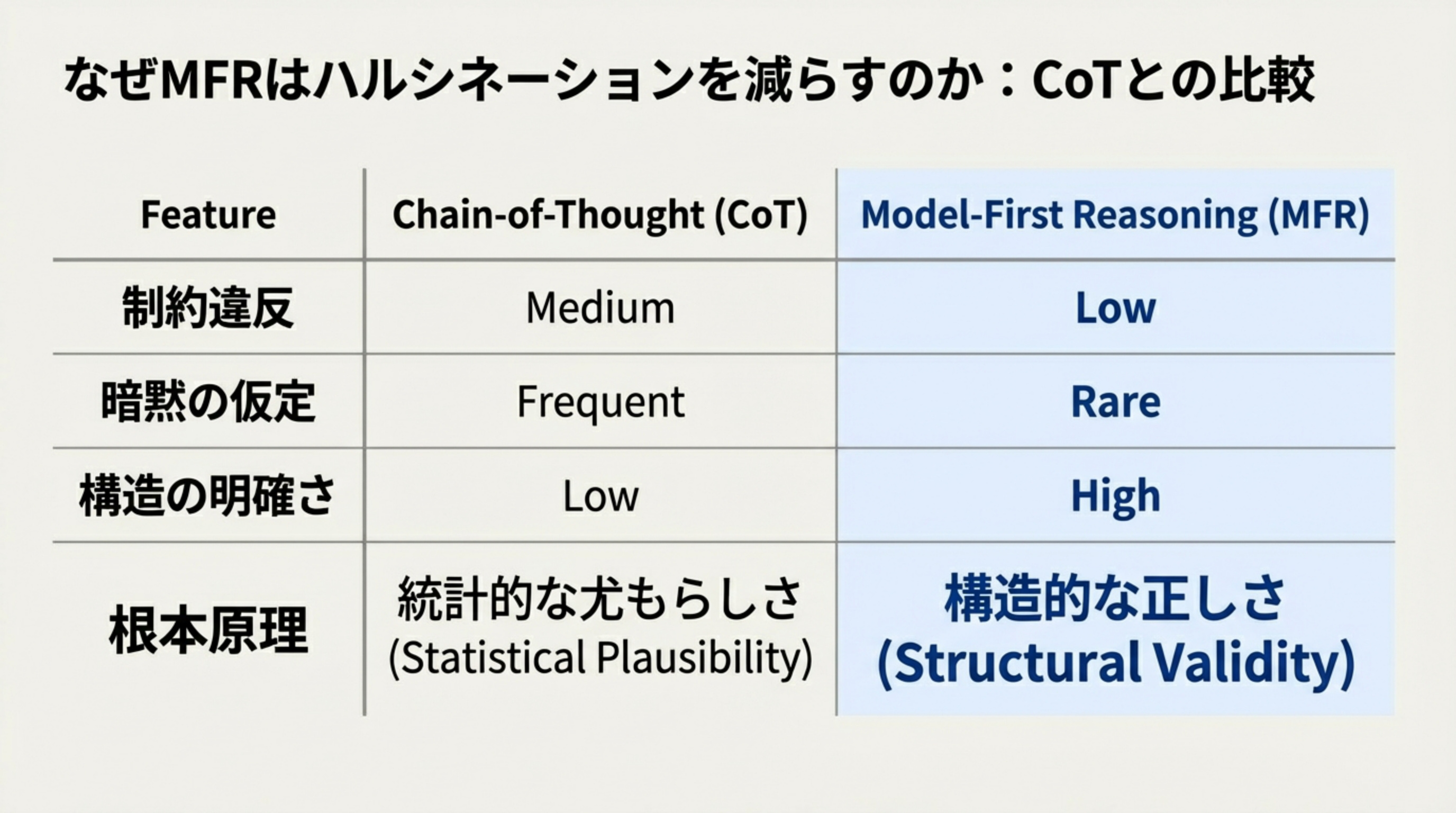

- 3 高い検証可能性: Chain-of-ThoughtやReActと比較して、より安定した計画を生成。

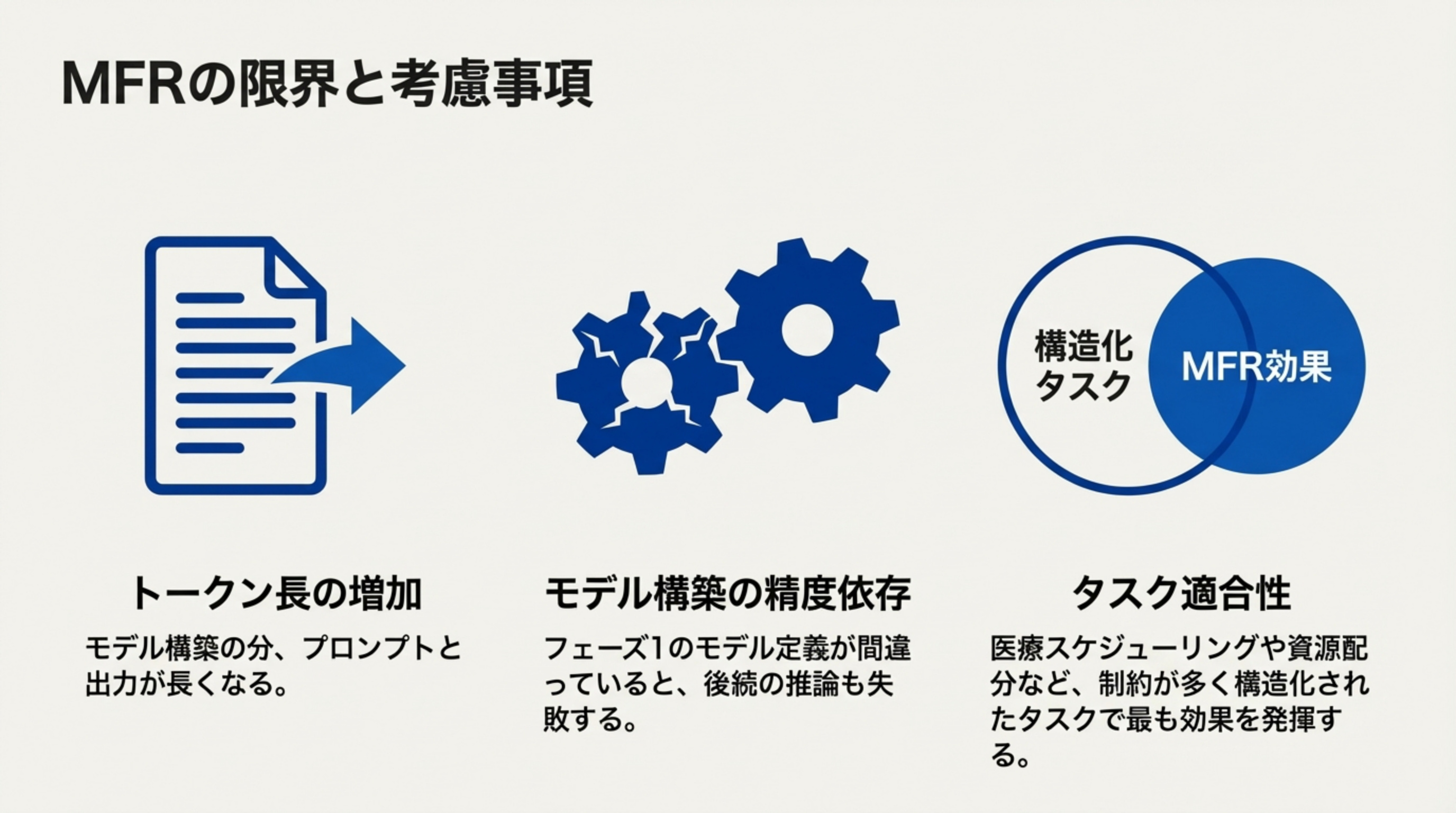

適用分野

スケジューリング、ルーティング、リソース割り当て、ロジックパズル等で効果を発揮。

制約遵守

制約違反が減少し、より明確な構造を持つ計画が作成される。

論文情報

arXiv:2512.14474 "Model-First Reasoning LLM Agents"

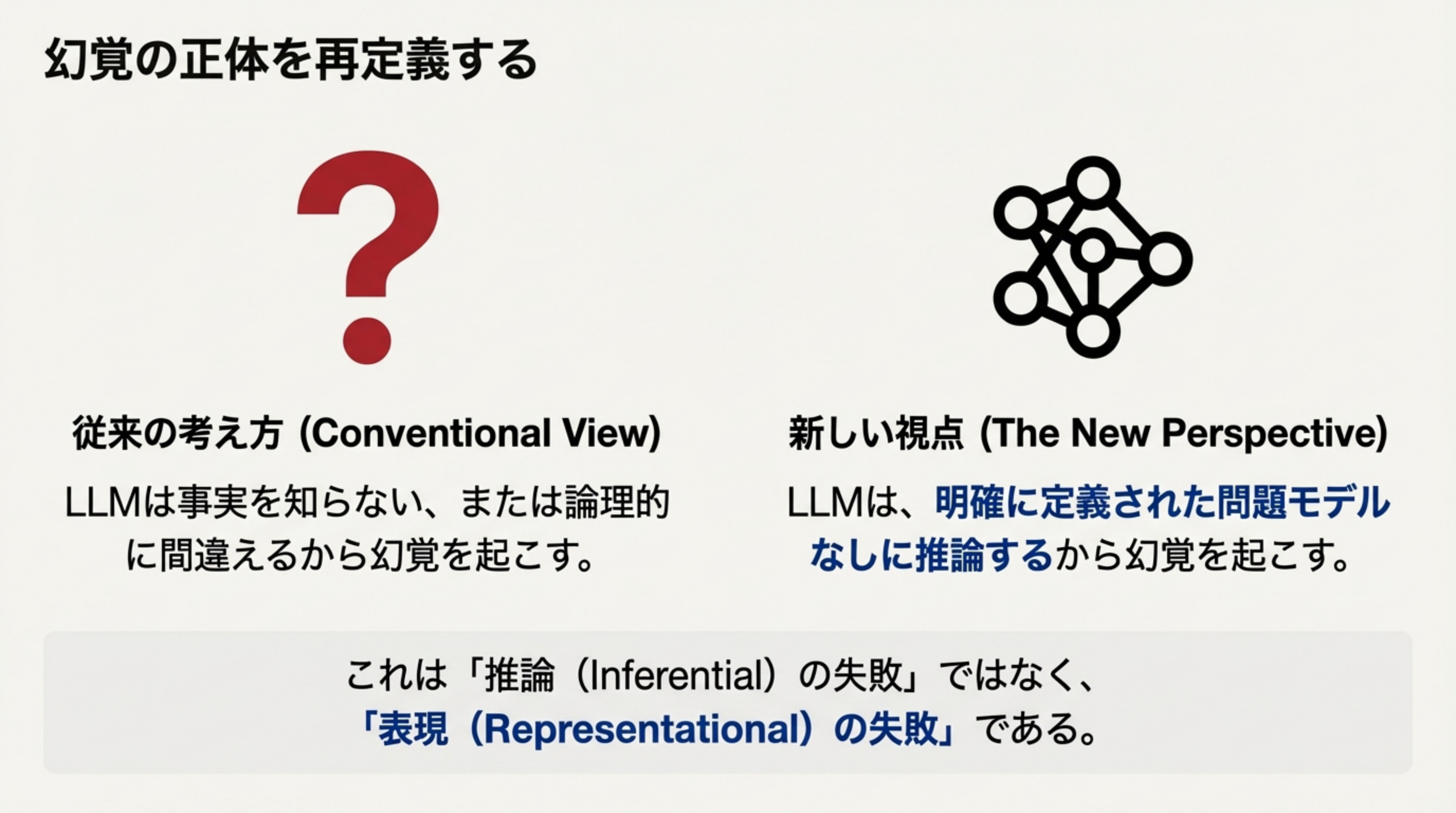

核心の主張

多くのハルシネーションは「表現のエラー」に起因します。最初に問題を明示的にモデル化することで、これらのエラーを根本から防ぐことができます。

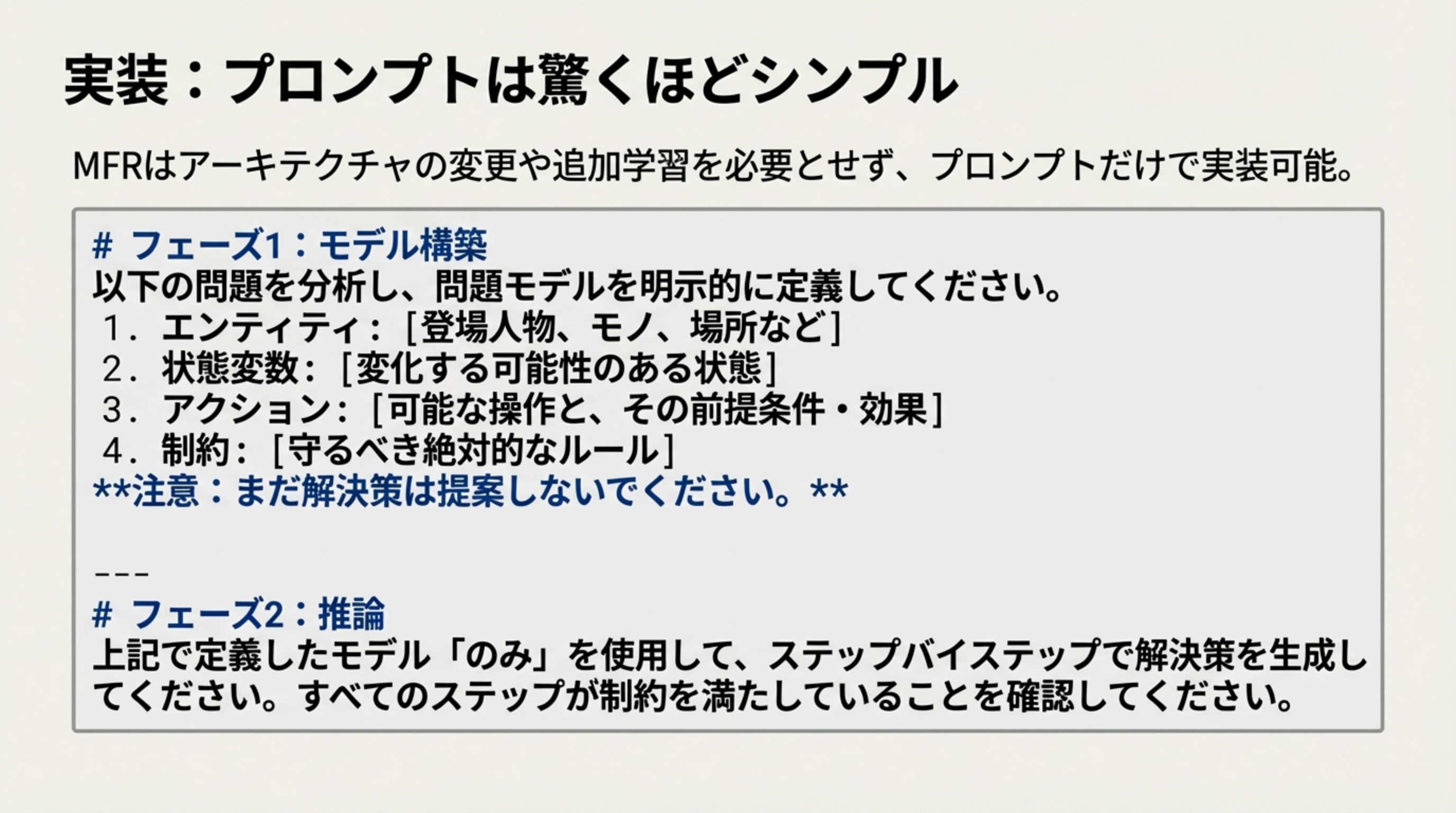

実装アプローチ

シンプルなプロンプトで実装可能であり、複雑なアーキテクチャ変更を必要とせずに、エージェントの信頼性を向上させる実用的な手法です。